こんにちは、スクーティー代表のかけやと申します。

弊社は生成AIを強みとするベトナムオフショア開発・ラボ型開発や、生成AIコンサルティングなどのサービスを提供しており、最近はありがたいことに生成AIと連携したシステム開発のご依頼を数多く頂いています。

Googleから発表されたばかりの Gemini 2.5 Pro Experimental は、これまでのAIの限界を超える可能性を秘めており、多くの注目を集めています。

「思考するAIって具体的に何ができるの?」「他のモデルと比べてどれくらい優れているの?」「Gemini 2.5 Pro Experimentalを使うと、どんなすごいことができるようになるんだろう?」そんな疑問や期待をお持ちではないでしょうか。Gemini 2.5 Pro Experimentalは、単に指示に従うだけでなく、複雑な問題に対して深く「考え」、最適な答えを導き出す能力を持っています。

実際に、様々なベンチマークで他の追随を許さない圧倒的なスコアを記録し、特にプログラミングや論理的な思考が求められるタスクでその真価を発揮しています。さらに、100万トークンという、これまでにない広大な情報処理能力も兼ね備えており、大規模なデータ分析や複雑なコーディングプロジェクトにも対応可能です。しかし、その全貌や具体的な活用方法については、まだ情報が少なく、どう活用すればよいか戸惑っている方もいるかもしれません。

この記事では、Gemini 2.5 Pro Experimentalの基本的な概念から、その驚異的なパフォーマンス、思考能力の仕組み、開発現場を変える可能性のあるコーディング能力、そして実際にどのような応用が可能なのかを示す豊富なデモンストレーションまで、公開されている情報を基に包括的に解説します。

Gemini 2.5 Pro Experimentalとは? – 新時代の思考するAIモデル登場

Gemini 2.5 Pro Experimentalの概要:Googleの最新鋭モデル

Googleが発表したGemini 2.5 Pro Experimentalは、現在利用可能なAIモデルの中で最もインテリジェントと位置付けられています。これは単なるアップデートではなく、「思考するモデル」として設計されており、これまで以上に複雑な問題に取り組む能力を持っています。このモデルファミリーの最初のリリースであるGemini 2.5 Pro Experimentalは、一般的なベンチマークにおいて他のモデルを大きく引き離す性能を示し、特に推論能力とコーディング能力において高い評価を得ています。

AIの分野における「推論」とは、単なる情報の分類や予測を超えた能力を指します。情報を分析し、論理的な結論を導き出し、文脈やニュアンスを理解し、情報に基づいた意思決定を行う能力のことです。Googleは、強化学習やChain-of-Thoughtプロンプティングといった技術を用いて、AIの推論能力を高める研究を長年続けてきました。これらの研究成果を基盤とし、さらに強化されたベースモデルと改良されたポストトレーニングを組み合わせることで、Gemini 2.5は新たなレベルのパフォーマンスを実現しました。

この「思考する能力」は、今後のGoogleのモデル開発における中核的な要素となり、より複雑な問題解決や、文脈を理解し自律的に動作するエージェントの開発を支えることが期待されます。Gemini 2.5 Pro Experimentalは、その第一歩となるモデルなのです。

「思考するモデル」とは?Gemini 2.5 Pro Experimentalの核心

Gemini 2.5 Pro Experimentalが「思考するモデル」と呼ばれる理由は、応答を生成する前に、内部で複数の思考プロセスを経ている点にあります。これは、人間が複雑な問題に取り組む際に、様々な角度から検討し、段階的に結論に至るプロセスに似ています。従来のモデルが与えられた情報から直接的な答えを生成しようとするのに対し、思考モデルは内部で複数の仮説を立て、検証し、論理的なステップを積み重ねることで、より正確で質の高い応答を生成しようとします。

具体的には、Gemini 2.5 Pro Experimentalは、応答を生成する前に大量のトークン(思考トークン)を出力します。このプロセスで、モデルは問題に対する様々なアプローチや解決策の候補を探り、それぞれの妥当性を評価します。この「考える時間」を持つことで、特にコーディング、数学、科学、論理パズルといった、正解が明確で検証可能な分野において、著しい性能向上が見られます。

この思考プロセスは、モデルがより複雑な指示や曖昧な要求にも対応できる理由の一つです。単に情報を検索して組み合わせるだけでなく、与えられた情報から新たな洞察を生み出したり、複数のステップが必要なタスクを計画・実行したりする能力が向上しています。例えば、ユーザーが抽象的なアイデアを提示した場合でも、思考モデルはその意図を深く理解し、具体的な計画やコードに落とし込むことができるのです。

Gemini 2.0 Flash Thinkingからの進化点

Gemini 2.5 Pro Experimentalは、Googleが以前に発表した思考モデル「Gemini 2.0 Flash Thinking」からさらに進化したモデルです。Gemini 2.0 Flash Thinkingは、思考能力を導入した最初のモデルの一つであり、その有効性を示すものでした。

Gemini 2.5 Pro Experimentalでは、この思考能力がさらに洗練されています。具体的には、以下の点が進化しています。

- ベースモデルの強化: 基礎となるAIモデル自体の能力が大幅に向上しています。これにより、より広範な知識と高度な言語理解能力を獲得しました。

- ポストトレーニングの改善: モデルの学習後の調整プロセスが改良され、思考能力の質と効率が向上しました。これにより、より複雑な推論タスクにおいても、より少ない思考ステップで、より正確な結論に到達できるようになっています。

- 思考能力の統合: Gemini 2.0 Flash Thinkingでは特定のタスクで思考能力が活用されていましたが、Gemini 2.5では、この思考能力がモデルの基本的な機能としてより深く統合されています。これにより、様々な種類のタスクにおいて、一貫して高い推論能力を発揮できるようになりました。

これらの進化により、Gemini 2.5 Pro Experimentalは、Gemini 2.0 Flash Thinkingと比較して、より困難な問題に取り組み、より信頼性の高い結果を提供することが可能になったと言えるでしょう。

Gemini 2.0シリーズに関しては以下の記事に、概要から詳細まで記載していますので、ぜひご覧ください!

関連記事:Gemini 2.0 全モデル完全解説: Flash, Lite, Proを比較

関連記事:Gemini 2.0: Google最新AIの速報

驚異的な性能!Gemini 2.5 Pro Experimentalの実力

ベンチマークを席巻!Gemini 2.5 Pro Experimentalの圧倒的スコア

Gemini 2.5 Pro Experimentalは、リリース直後から様々な業界標準ベンチマークで他の最先端モデルを凌駕する結果を示しています。特に、高度な推論能力、数学的能力、科学的知識、そしてコーディング能力を測定するテストにおいて、その性能は際立っています。

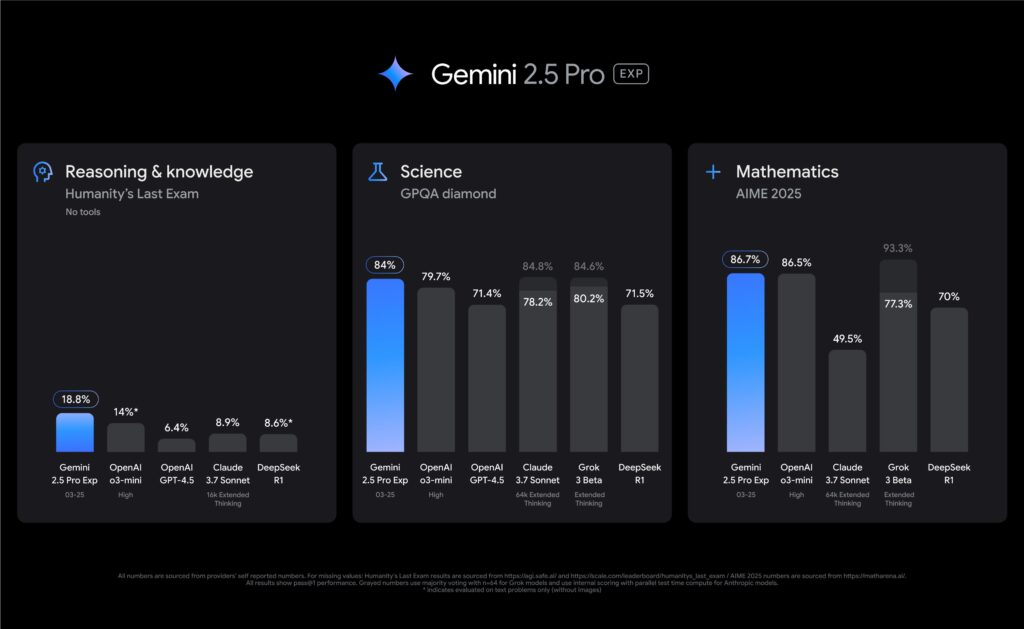

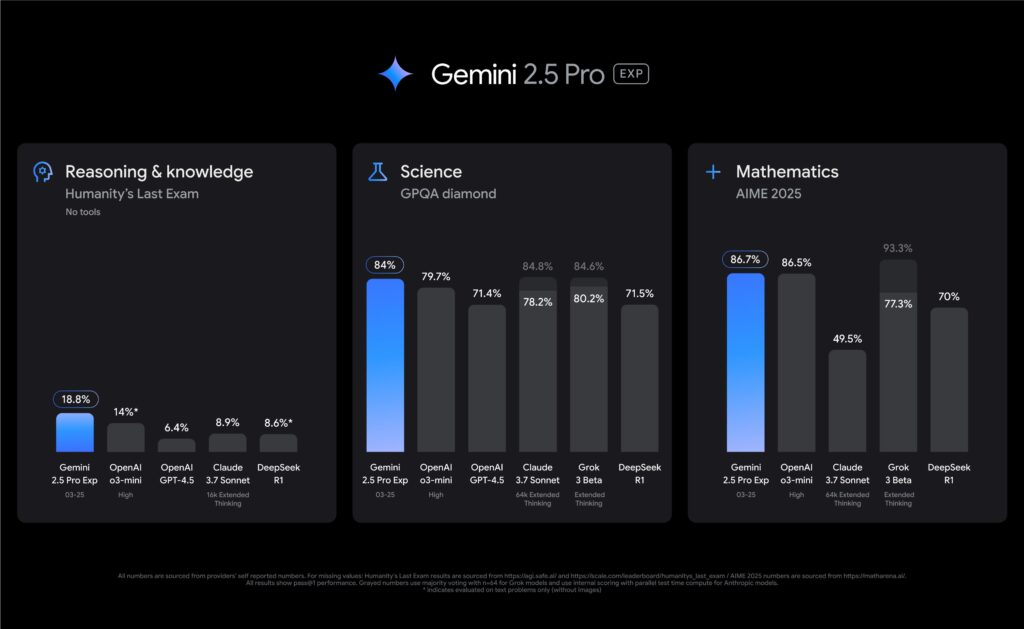

以下に示す表は、Gemini 2.5 Pro Experimentalと他の主要な大規模言語モデル(OpenAI o3-mini High, OpenAI GPT-4.5, Claude 3.7 Sonnet 64k Extended thinking, Grok 3 Beta Extended thinking, DeepSeek R1)とのベンチマーク結果を比較したものです。特に断りのない限り、Gemini 2.5 Pro Experimentalのスコアは、追加の計算コストを伴うテスト時テクニック(マジョリティ・ヴォーティングなど)を使用せずに得られたものです。

この表から、Gemini 2.5 Pro Experimentalが多くの項目で最高スコア(太字でハイライト)を獲得していることがわかります。

- Humanity’s Last Exam (no tools): 人間の知識と推論の限界を測るために設計されたデータセット。Gemini 2.5 Pro Experimentalはツールを使用せずに18.8%を達成し、2位の14.0%を大きく上回っています。

- GPQA diamond (single attempt): 科学分野の難問に対する正答率。84.0%というスコアは、他のモデルと比較して顕著に高いです。

- AIME 2025 / 2024 (single attempt): 高度な数学の問題解決能力を測るベンチマーク。特にAIME 2024では92.0%と、他モデルを圧倒しています。

- Aider Polyglot (whole / diff): コード編集能力を測るベンチマーク。特に全体編集(whole)で74.0%という高いスコアを示しています。

- MMMU (single attempt): マルチモーダル(視覚情報を含む)推論能力。81.7%というスコアは、視覚情報処理能力の高さを示唆します。

- MRCR (128k average / 1M pointwise): 長文脈における情報理解・参照能力。128kトークンの平均で94.5%、1Mトークンでも83.1%という高い精度を維持しています。

これらの結果は、Gemini 2.5 Pro Experimentalが単に知識が豊富なだけでなく、それを活用して複雑な問題を解決する高度な知的能力を持っていることを示しています。

こちらの棒グラフは、特に推論、科学、数学のカテゴリにおけるGemini 2.5 Pro Experimentalの性能を視覚的に示しています。多くのテストで他の最先端モデルを上回る結果となっていることが一目でわかります。

LMArenaでNo.1!ユーザー評価が示すGemini 2.5 Pro Experimentalの魅力

ベンチマークスコアだけでなく、実際のユーザーによる評価でもGemini 2.5 Pro Experimentalは最高レベルの評価を得ています。LMArena(Large Model Arena)は、ユーザーが匿名化された2つのモデルの応答を比較し、どちらが優れているかを投票するプラットフォームです。

Gemini 2.5 Pro Experimentalは、リリース直後にこのLMArenaのリーダーボードで首位を獲得し、その座を維持しています(2025年3月時点の情報に基づく)。特筆すべきは、2位のモデル(Grok 3 Preview)に対してELOレーティングで有意な差をつけている点です(Gemini 2.5 Pro: 1443, Grok 3 Preview: 1404)。

LMArenaでの高い評価は、Gemini 2.5 Pro Experimentalが単に技術的な指標で優れているだけでなく、人間が感じる応答の質、自然さ、スタイルの良さにおいても非常に高いレベルにあることを示唆しています。ユーザーは、その応答の的確さ、創造性、そして対話の流れのスムーズさを高く評価していると考えられます。これは、モデルが技術的なタスクだけでなく、より人間らしいコミュニケーションにおいても優れた能力を持っていることの証左と言えるでしょう。

他モデルとの詳細比較:Gemini 2.5 Pro Experimentalの優位性

先に示したベンチマーク表(上記)は、Gemini 2.5 Pro Experimentalと他の主要モデルとの性能差を具体的に示しています。いくつかの重要な比較ポイントを挙げます。

- 推論・知識 (Humanity’s Last Exam): Gemini 2.5 Pro Experimental (18.8%) は、OpenAI o3-mini High (14.0%) や Claude 3.7 Sonnet (8.9%) と比較して、ツールなしでの推論能力で明確な優位性を示しています。これは、モデル自身の思考能力の高さを示唆します。

- 数学 (AIME 2025/2024): 数学ベンチマークでは、特にシングルアテンプト(一発解答)での性能が高いです。AIME 2024では92.0%を達成し、o3-mini (87.3%) や Grok 3 Beta (83.9%) を上回っています。これは、複雑な数学的問題を正確に解く能力が高いことを意味します。

- コーディング (Aider Polyglot): コード編集タスクでは、Gemini 2.5 Pro Experimental (whole 74.0% / diff 68.6%) が Claude 3.7 Sonnet (diff 64.9%) や o3-mini (diff 60.4%) よりも優れた結果を出しています。これは、既存のコードを理解し、修正・改善する能力が高いことを示します。

- エージェント的コーディング (SWE-bench Verified): このベンチマークでは、Claude 3.7 Sonnet (70.3%) がGemini 2.5 Pro Experimental (63.8%) を上回る結果となっています。これは、特定のツールやエージェント設定を用いた場合の性能差を示しており、今後の改善が期待される分野です。しかし、Googleのカスタムエージェント設定を用いた結果であり、単純比較は難しい側面もあります。

- マルチモーダル (MMMU): Gemini 2.5 Pro Experimental (81.7%) は、画像を含むマルチモーダルな推論タスクにおいて、GPT-4.5 (74.4%) や Claude 3.7 Sonnet (75.0%)、Grok 3 Beta (76.0%) よりも高い性能を示しています。

- 長文脈 (MRCR): 128kトークンの平均精度で94.5%と、o3-mini (61.4%) や GPT-4.5 (64.0%) を大きく引き離しています。100万トークンという長大な文脈でも高い精度 (83.1%) を維持できる点は、Gemini 2.5 Pro Experimentalの大きな特徴です。

詳細は上記「ベンチマークを席巻!Gemini 2.5 Pro Experimentalの圧倒的スコア」の項の表を参照してください。

これらの比較から、Gemini 2.5 Pro Experimentalは特に推論、数学、コード編集、マルチモーダル、長文脈処理において、現行の最先端モデルと比較しても(評価条件を考慮してもなお)高い競争力を持っていることがわかります。

100万トークン対応!Gemini 2.5 Pro Experimentalの長文脈処理能力

Gemini 2.5 Pro Experimentalの特筆すべき能力の一つが、その広大なコンテキストウィンドウです。現在、100万トークンの入力に対応しており、将来的には200万トークンへの拡張も予定されています。(2025年3月時点)

トークンとは、テキストを処理する際の基本的な単位で、英語ではおおよそ1トークンが4文字程度、日本語ではより少ない文字数(1文字〜数文字)に対応します。100万トークンというコンテキストウィンドウは、非常に大量の情報を一度に処理できることを意味します。

具体的には、以下のようなことが可能になります。

- 大規模なドキュメントの読解・分析: 数百ページに及ぶ技術文書、研究論文、書籍全体などを一度に読み込み、内容を要約したり、特定の情報を抽出したり、質問に答えたりすることができます。

- 長大なコードベースの理解: 大規模なソフトウェアプロジェクトのコード全体をコンテキストとして与え、コードの構造を理解させたり、バグを発見させたり、新しい機能を追加させたりすることが容易になります。

- 複数ソースからの情報統合: テキスト、音声、画像、動画、コードリポジトリなど、様々な形式の大量の情報を一度に入力し、それらを横断的に分析して複雑な問いに答えることが可能です。

- 長時間の対話履歴の維持: ユーザーとの非常に長い対話履歴を記憶し続けることができるため、文脈を踏まえた一貫性のある応答が期待できます。

MRCR (Multi Round Coreference Resolution) ベンチマークの結果が示すように、Gemini 2.5 Pro Experimentalは100万トークンという長文脈においても、情報の参照精度を高く維持できます(1M pointwiseで83.1%)。これは、単に長い情報を保持できるだけでなく、その中から必要な情報を正確に見つけ出し、活用する能力が高いことを意味します。この長文脈処理能力は、開発者や企業がこれまで扱えなかった規模のデータやタスクに取り組むことを可能にするでしょう。

マルチモーダル性能:テキスト、画像、音声、動画を理解するGemini 2.5 Pro Experimental

Gemini 2.5 Pro Experimentalは、テキストだけでなく、画像、音声、動画といった多様な形式の情報をネイティブに理解できるマルチモーダルAIモデルです。これは、Geminiファミリーのモデルが当初から持つ大きな特徴であり、Gemini 2.5 Pro Experimentalでもその能力は健在です。

具体的には、以下のような能力を持っています。

- 画像理解: 画像の内容を説明したり、画像に関する質問に答えたり、画像内のオブジェクトを認識したりできます。MMMUベンチマークで81.7%という高いスコアを達成していることからも、その高度な画像理解能力がうかがえます。Vibe-Evalベンチマークでも69.4%のスコアです。

- 音声理解: 音声データをテキストに変換するだけでなく、音声の内容を理解し、要約したり質問に答えたりできます。(ただし、現行の`gemini-2.5-pro-exp-03-25`モデルのAPIドキュメントでは、入力はAudio, images, video, text、出力はTextと記載されています。音声生成はサポートされていません。)

- 動画理解: 動画の内容をフレームごとに分析し、動画全体のストーリーを理解したり、特定のシーンについて説明したりできます。

これらのマルチモーダル能力と、前述の長文脈処理能力を組み合わせることで、Gemini 2.5 Pro Experimentalは非常に強力な情報処理プラットフォームとなります。例えば、会議の議事録(テキスト)、プレゼンテーション資料(画像・テキスト)、会議の録画(動画・音声)をすべて入力し、会議全体の要約を作成したり、特定の決定事項について質問したりといった、複雑なタスクを実行できるようになります。

開発者や企業は、このネイティブなマルチモーダル能力を活用して、これまで実現できなかったような、よりリッチでインタラクティブなアプリケーションやサービスを構築できる可能性を秘めています。

Gemini 2.5 Pro Experimentalの核心技術:思考と推論能力

思考プロセスのメカニズム:Gemini 2.5 Pro Experimentalはどう考えるか

Gemini 2.5 Pro Experimentalの「思考」は、応答を生成する前に内部的に行われる一連の計算プロセスです。これは、プロンプトで明示的に指示するChain-of-Thought(CoT)とは異なり、モデルが自律的に行うものです。ユーザーがプロンプトを入力すると、モデルは最終的な応答を返す前に、「思考ステップ」と呼ばれる中間的な推論プロセスを実行します。この思考プロセスには、数十秒から場合によっては数分程度の時間(レイテンシ)がかかることがあります。

この思考ステップでは、モデルは以下のようなことを行っていると考えられます。

- 問題の分解: 複雑な問題を、より管理しやすい小さなサブ問題に分解します。

- 情報の検索と抽出: 内部知識や与えられたコンテキストから、各サブ問題を解決するために必要な情報を検索・抽出します。

- 仮説生成と評価: 解決策の候補となる複数の仮説を生成し、それぞれの妥当性や実現可能性を評価します。

- 論理的推論: 演繹、帰納、類推などの論理的なルールを用いて、情報や仮説を結びつけ、結論を導き出します。

- 計画立案: 複数のステップが必要なタスクの場合、実行順序を計画します。

- 自己修正: 推論の過程で矛盾や誤りを発見した場合、思考プロセスを修正し、より適切な経路を探します。

Google AI Studioなどのインターフェースでは、この思考プロセスの一部を実際に確認できる場合があります。ユーザーは「Thinking…」と表示されている箇所や、「Expand to view model thoughts」といったオプションを選択することで、モデルが最終的な応答に至るまでにどのような思考ステップ(サブ問題への分解、考慮事項、コード構造の計画など)を経たのかを垣間見ることができます。これにより、モデルの推論プロセスを理解し、プロンプトを改善したり、モデルの応答の信頼性を評価したりするのに役立ちます。

この思考プロセスは、特に以下のようなタスクで効果を発揮します。

- 複雑なコーディング: アルゴリズムの設計、デバッグ、コードの最適化など。

- 数学的問題解決: 証明問題、応用問題など、多段階の推論が必要な問題。

- 科学的推論: 実験結果の解釈、仮説検証など。

- 創造的なタスク: ストーリー生成、アイデア発想など、多様な可能性を探る必要があるタスク。

思考能力は、Gemini 2.5 Pro Experimentalが単なる情報検索エンジンではなく、真の「問題解決パートナー」となるための重要な要素です。

推論能力の向上:なぜGemini 2.5 Pro Experimentalは賢いのか

Gemini 2.5 Pro Experimentalが高い推論能力を持つ理由は、いくつかの要因が複合的に作用している結果と考えられます。

- 強化されたベースモデル: モデルの基礎となるニューラルネットワークの規模や構造が改善され、より多くの知識を学習し、複雑なパターンを認識する能力が向上しています。これにより、より深いレベルでの情報理解が可能になりました。

- 思考プロセスの導入: 前述の通り、応答前に内部的な思考ステップを経ることで、複雑な問題に対してより体系的かつ論理的にアプローチできるようになりました。これにより、即時的な応答生成では到達できなかったような、より高度な結論を導き出すことが可能になります。

- 改良されたポストトレーニング: モデルの学習後に行われる微調整(ファインチューニングやRLHF:人間のフィードバックからの強化学習など)のプロセスが改善されています。これにより、モデルの推論能力が特定のタスクや人間の要求により適合するように最適化され、思考の質と効率が向上しています。

- 大規模データによる学習: より多様で大規模なデータセットを用いて学習することで、モデルは広範な知識と、それらを結びつけて推論するためのパターンを獲得しています。

- 長文脈処理能力: 100万トークンという広大なコンテキストウィンドウにより、問題解決に必要な情報をより多く保持し、それらを統合して推論を進めることができます。

これらの要因が組み合わさることで、Gemini 2.5 Pro Experimentalは、単に情報を記憶・再生するだけでなく、情報を能動的に分析し、論理的な結論を導き、未知の問題に対しても効果的な解決策を見つけ出すという、高度な「知性」を発揮することができるのです。特に、Humanity’s Last ExamやGPQA、AIMEといったベンチマークでの高いスコアは、その推論能力の高さを客観的に示しています。

コーディングの新時代へ:Gemini 2.5 Pro Experimentalの高度な開発力

コーディング性能の大幅向上:Gemini 2.0からの飛躍

Googleは、Gemini 2.5 Pro Experimentalの開発において、コーディング性能の向上に特に注力してきました。その結果、前世代のGemini 2.0と比較して、コーディング能力が大幅に向上しています。

具体的な改善点としては、以下が挙げられます。

- 複雑なアプリケーションの生成: 視覚的に魅力的でインタラクティブなWebアプリケーションや、複数のコンポーネントが連携して動作するエージェント的なコードアプリケーションの生成能力が向上しました。単純なスクリプトだけでなく、より実践的なソフトウェア開発タスクに対応できます。

- コード変換と編集: 既存のコードを別の言語に変換したり、特定の要件に合わせてコードを修正・リファクタリングしたりする能力が向上しています。Aider Polyglotベンチマークでの高いスコア(whole 74.0% / diff 68.6%)は、この能力を裏付けています。

- エージェント的コーディング能力: SWE-bench Verifiedのような、自律的にコーディングタスクを進めるエージェントの性能評価においても、63.8%という高いスコアを記録しています(カスタムエージェント設定下)。これは、モデルが単にコードスニペットを生成するだけでなく、より大きな開発タスクを理解し、計画的に実行できる可能性を示唆しています。

- 思考能力の活用: コーディングにおいても思考プロセスが活用されており、複雑なアルゴリズムの設計やデバッグにおいて、より効果的なアプローチを見つけ出すことができます。

これらの向上により、Gemini 2.5 Pro Experimentalは、開発者の生産性を大幅に向上させるポテンシャルを持っています。アイデアを迅速にプロトタイプ化したり、定型的なコーディング作業を自動化したり、あるいは複雑なバグの原因究明を支援したりと、ソフトウェア開発ライフサイクルの様々な場面で活躍することが期待されます。

Googleは、今後もコーディング性能の改善を続けるとしており、Gemini 2.5 Pro Experimentalは開発者にとってますます強力なツールとなるでしょう。

SWE-Bench Verifiedでの高スコアとその意味

SWE-Bench Verifiedは、実際のソフトウェア開発における問題解決能力を測定するために設計された、業界標準のベンチマークの一つです。このベンチマークでは、GitHubのissue(バグ報告や機能リクエスト)と、それに対応するプルリクエスト(コード変更の提案)のペアが用いられます。AIモデルは、issueの内容を理解し、それを解決するためのコード変更(パッチ)を生成するタスクに挑戦します。

Gemini 2.5 Pro Experimentalは、Googleが開発したカスタムのエージェント設定を用いた場合、このSWE-Bench Verifiedで63.8%というスコアを記録しました。これは、提示されたソフトウェアの問題の約6割以上に対して、正しいコード修正案を生成できたことを意味します。

このスコアが高いことの意味は以下の通りです。

- 実践的な問題解決能力: SWE-Benchは、理論的なコーディング問題ではなく、実際のソフトウェアリポジトリから取られた現実的な問題を扱います。そのため、このベンチマークでの高スコアは、Gemini 2.5 Pro Experimentalが実際の開発現場で役立つ可能性が高いことを示唆しています。

- エージェントとしての可能性: 単にコードを生成するだけでなく、問題(issue)を理解し、解決策(コード変更)を自律的に生成するという、より高度な「エージェント的」な能力を持っていることを示しています。将来的には、バグ修正や小規模な機能追加などをAIが自動で行うようになるかもしれません。

- コード理解と修正能力: 既存のコードベースを理解し、その文脈の中で適切な修正を行う能力が求められます。高スコアは、この能力が高いことを意味します。

ただし、注意点として、この63.8%というスコアは「カスタムエージェント設定」下での結果であり、他のモデル(例えばClaude 3.7 Sonnetは70.3%を記録)とは設定が異なる可能性があるため、単純な比較は難しい側面もあります。それでも、Gemini 2.5 Pro Experimentalが複雑なソフトウェア開発タスクにおいて高い潜在能力を持っていることは明らかです。

Gemini 2.5 Pro Experimentalが可能にする驚きのデモンストレーション

複雑なシミュレーションをワンショットで生成

Gemini 2.5 Pro Experimentalの最も印象的な能力の一つは、複雑なシミュレーションやインタラクティブなデモを、最小限の指示(多くの場合ワンショット)で生成できる点です。

これは、以下の能力の組み合わせによって実現されています。

- 高度なプロンプト理解: ユーザーが自然言語で記述した抽象的なアイデアや複雑な要件を正確に理解します。「レゴブロックのシミュレーション」「アリの巣観察キット風」「ウイルスと細胞の戦い」といったコンセプトを、具体的な機能や技術的要素に落とし込むことができます。

- 思考による計画立案: 最終的なコードを生成する前に、思考プロセスを通じて、必要なコンポーネント(例:3Dレンダリング、物理演算、UI要素、ゲームロジック)、データの構造、アルゴリズムなどを計画します。

- 多様な技術の統合: 3JS, p5.js, Pygameといった異なるライブラリやフレームワークを適切に選択し、それらを組み合わせて目的のアプリケーションを構築できます。

- コード生成能力: 計画に基づいて、実際に動作する、効率的で比較的バグの少ないコードを生成します。

- 長文脈の活用: 複雑なシミュレーションでは多くのコード行が必要になりますが、100万トークンという長文脈能力により、大規模なコードでも一貫性を保ちながら生成を進めることができます。

また、複雑なプロンプトを作成する際のTIPSとして、「基本的なアイデアを他のLLM(例えばChatGPT)に与え、より詳細で具体的な指示に展開してもらう」という手法があります。このようにプロンプトを工夫することも、Gemini 2.5 Pro Experimentalのような高度なモデルの能力を最大限に引き出す上で有効です。

ルービックキューブ、レゴビルダー、高度なスネークゲーム、トーラス結び目、アリの巣、ウイルスシミュレーション、手術シミュレーターといったデモは、いずれもワンショットまたはごく少ないやり取りで生成されており、これは他の多くのモデルでは達成困難なレベルです。これらのデモは、Gemini 2.5 Pro Experimentalが単なるコード補完ツールではなく、アイデアを具体的な形にするための強力な「開発パートナー」となり得ることを示しています。

開発者は、この能力を活用して、新しいアイデアのプロトタイピングを迅速に行ったり、教育用のインタラクティブな教材を作成したり、あるいは複雑なシステムの挙動を可視化したりすることが、これまで以上に容易になるでしょう。

インタラクティブなデモ事例:Rubik’s CubeからLego Builderまで

ここでは、以下のYouTube動画で紹介されていた特に印象的なインタラクティブデモについて、もう少し詳しく見ていきたいと思います。

- Rubik’s Cube Simulation:

機能: ユーザー指定サイズの3Dルービックキューブ生成、回転操作、視点変更、スクランブル、解法アニメーション表示。

特筆すべき点: 回転中の色・位置の正確な保持。10×10でも正確に動作。3JSを用いた複雑な3Dジオメトリ操作、高度な状態管理能力、滑らかなアニメーション制御能力を示します。ワンショット生成能力の高さが際立ちます。 - Lego Builder Simulation:

機能: 3D空間でのレゴブロック組み立て。グリッドスナップ、衝突検知、回転、カメラ操作。

特筆すべき点: スナップ機能と衝突検知の正確性。3JSを用いたインタラクティブな3D環境構築、グリッドスナップや衝突検知といった物理演算に近いロジックの実装能力を示します。ワンショットで高完成度のデモを生成(スタッド描画は改善点あり)。 - Advanced Snake Game:

機能: Pygame製。光る軌跡、背景変化、パーティクルエフェクト、特殊な餌(パワーアップ)、蛇の進化、障害物、AI対戦相手など多数の要素を追加。

特筆すべき点: 多くの独自機能と視覚効果を矛盾なく統合。Pygameを用いた複雑なゲームロジック、動的なビジュアルエフェクト、多様なパワーアップ要素、AI対戦相手の実装など、多岐にわたる要求を統合する能力をワンショットで実現。 - Interactive 3D Torus Knot:

機能: 3JS製。トーラス結び目をGUIスライダーで形状、見た目、アニメーション、照明などをリアルタイムに変更可能。

特筆すべき点: 複雑な3Dジオメトリ生成と多数のUI要素(スライダー)の正確な連携。3JSでの複雑な数式に基づいたジオメトリ生成と、多数のパラメータをリアルタイムに反映させるUI連携が見事です。ワンショット生成。

これらのデモは、Gemini 2.5 Pro Experimentalが単にコードを書くだけでなく、インタラクティブ性、ビジュアルデザイン、複雑なロジック、状態管理といった、高度なアプリケーション開発に必要な要素を統合的に扱えることを示しています。

AIによる開発支援の未来像

Gemini 2.5 Pro Experimentalのような高度な思考能力とコーディング能力を持つAIモデルの登場は、ソフトウェア開発の未来に大きな影響を与える可能性があります。

- プロトタイピングの加速: アイデアを思いついたら、自然言語で指示するだけで、動作するプロトタイプを迅速に生成できるようになります。これにより、アイデアの検証やフィードバック収集のサイクルが大幅に短縮されます。

- 定型作業の自動化: UIコンポーネントの作成、API連携コードの記述、ユニットテストの生成といった、比較的定型的なコーディング作業をAIに任せることで、開発者はより創造的で複雑な問題解決に集中できるようになります。

- 学習と教育の支援: 初学者がプログラミングの概念を理解したり、特定のライブラリの使い方を学んだりする際に、インタラクティブな例題やコードスニペットをAIが即座に生成してくれます。また、自分のコードに対する改善提案やデバッグ支援も期待できます。

- 複雑な問題への挑戦: これまで人間だけでは実装が困難だった複雑なシミュレーション、高度なアルゴリズム、大規模なデータ分析などを、AIとの協働によって実現できるようになるかもしれません。SWE-Benchでの結果は、AIがバグ修正などの実践的なタスクを支援できる可能性を示唆しています。

- 開発者の役割の変化: コーディングそのものよりも、AIに対して的確な指示を与え、生成されたコードを評価・修正し、システム全体を設計・統合する能力がより重要になる可能性があります。開発者は「AIトレーナー」や「AIオーケストレーター」のような役割を担うようになるかもしれません。プロンプト作成においても、基本的なアイデアを他のLLMで詳細化するといった工夫が求められるようになるかもしれません。

- ノーコード/ローコード開発の進化: AIがバックグラウンドで複雑なコードを生成することで、プログラミング知識が少ない人でも、より高度なアプリケーションを構築できるプラットフォームが登場する可能性があります。

Gemini 2.5 Pro Experimentalは、こうした未来像の実現に向けた大きな一歩と言えます。その思考能力とコーディング能力は、開発プロセスを根本的に変革し、ソフトウェア開発をより効率的で、創造的で、アクセスしやすいものにする可能性を秘めています。

Gemini 2.5 Pro Experimentalを今すぐ試す方法

Google AI Studioでの利用方法

Gemini 2.5 Pro Experimentalは、現在、Google AI Studioを通じて無料で試すことができます。(2025年3月時点)

利用手順は以下の通りです。

- Google AI Studioにアクセス: Webブラウザで https://aistudio.google.com/ にアクセスします。Googleアカウントでのログインが必要になる場合があります。

- モデルの選択: インターフェース上で、利用するモデルを選択するドロップダウンメニューや設定項目があります。ここで「 gemini-2.5-pro-exp-03-25 」を選択します。(最新のモデル名や利用可否は変更される可能性があります。)

- プロンプトの入力: テキスト入力エリアに、モデルに実行させたい指示(プロンプト)を入力します。

- パラメータ設定(任意):

- Temperature: 応答のランダム性を調整します。値を高くするとより創造的で多様な応答になり、低くするとより決定的で一貫性のある応答になります。デフォルト値(通常は1.0前後)から試すのが良いでしょう。コーディングタスクでは少し低め(例: 0.7)に設定することも有効です。

- Token limit: 最大応答トークン数を設定できますが、Gemini 2.5 Pro Experimentalは最大65,536トークンまで出力可能です。

- Safety settings: 有害なコンテンツの生成をブロックする設定です。必要に応じて調整できますが、通常はデフォルト設定のままで問題ありません。

- Tools: 関数呼び出し(Function calling)やGoogle検索によるグラウンディング(Search grounding)などのツールを利用するかどうかを設定できます。

- 実行: 「Run」や「Submit」といったボタンをクリックすると、モデルがプロンプトを処理し、応答(コード、テキスト、思考プロセスなど)を生成します。思考モデルであるため、応答が返ってくるまでに数十秒から数分程度の時間がかかる場合がある点に留意してください。

- 思考プロセスの確認(思考モデルの場合): 応答が表示される際に、「Thinking…」や思考プロセスを表示するオプション(例: 「Expand to view model thoughts」)が表示されることがあります。これをクリックすると、モデルが最終応答に至るまでの中間的な思考ステップを確認できます。

Google AI Studioは、Gemini 2.5 Pro Experimentalの能力を手軽に試し、様々なプロンプトや設定の効果を実験するのに最適な環境です。特に、思考プロセスを確認できる点は、モデルの挙動を理解する上で非常に有用です。

Gemini AdvancedとVertex AIでの展開予定

Gemini 2.5 Pro Experimentalは、Google AI Studioでの提供に加え、他のGoogle製品やサービスにも順次展開される予定です。

- Gemini Advanced: Googleの有料サブスクリプションサービスであるGemini Advancedのユーザーは、Gemini 2.5 Pro ExperimentalをGeminiアプリ(Webおよびモバイル)のモデル選択ドロップダウンから選択して利用できるようになっています。(2025年3月時点)これにより、日常的な対話やタスク実行において、最新鋭モデルの能力を活用できます。

- Vertex AI: Google Cloudのエンタープライズ向けAIプラットフォームであるVertex AIでも、Gemini 2.5 Pro Experimentalが近日中に利用可能になる予定です。Vertex AIを通じて利用することで、企業はより高いレート制限(API呼び出し頻度の上限)や、本番環境でのスケーラブルな利用、他のGoogle Cloudサービスとの連携といった恩恵を受けることができます。Vertex AIでの提供開始に合わせて、具体的な料金体系も発表される見込みです。

これにより、個人ユーザーから開発者、そして大企業まで、幅広い層がGemini 2.5 Pro Experimentalの高度な能力をそれぞれのニーズに合わせて活用できるようになります。Googleは、ユーザーからのフィードバックを収集し、モデルの能力をさらに向上させていくとしています。

モデル詳細:スペックと技術的情報

Google AI Developerのドキュメントによると、Gemini 2.5 Pro Experimental(モデルコード: gemini-2.5-pro-exp-03-25)の主なスペックと技術情報は以下の通りです。(2025年3月時点)

| Property | Description |

|---|---|

| モデルコード | gemini-2.5-pro-exp-03-25 |

| サポートされるデータタイプ | 入力Audio, images, video, and text 出力Text |

| トークン制限 | 入力トークン制限1,048,576 (約100万) 出力トークン制限65,536 |

| 機能 | 構造化出力サポート キャッシング非サポート チューニング非サポート 関数呼び出しサポート コード実行サポート 検索グラウンディングサポート 画像生成非サポート ネイティブツール使用サポート 音声生成非サポート Live API非サポート 思考 (Thinking)サポート |

| バージョン | モデルバージョンの詳細についてはモデルバージョンパターンを参照してください。 Experimental: gemini-2.5-pro-exp-03-25 |

| 最終更新 | March 2025 |

| 知識カットオフ | January 2025 |

主なポイント:

- マルチモーダル入力: 音声、画像、動画、テキストを入力として受け付けます。

- テキスト出力: 出力はテキスト形式です。

- 広大な入力トークン制限: 最大1,048,576トークン(約100万トークン)の情報を一度に入力できます。これは、大規模なドキュメントやコードベースの処理に非常に有利です。

- 大きな出力トークン制限: 最大65,536トークンまで出力可能です。詳細な説明や長いコードの生成に対応できます。

- 豊富な機能サポート: 構造化出力(JSONなど指定形式での出力)、外部APIと連携する関数呼び出し、生成コードを実行するコード実行、Google検索で情報を補強する検索グラウンディング、内部ツールを自律的に使うネイティブツール使用、そしてモデルの核となる思考(Thinking)機能をサポートしています。

- チューニング非サポート: 現時点では、ユーザーが特定のタスクに合わせてモデルをファインチューニングすることはできません。(Experimental版のため)

- 最新の知識: 知識カットオフは2025年1月であり、比較的新しい情報に基づいた応答が期待できます。

これらのスペックは、Gemini 2.5 Pro Experimentalが非常に高性能かつ多機能なモデルであることを示しています。特に、100万トークンの入力と思考能力の組み合わせは、これまでのAIモデルでは不可能だったレベルのタスク遂行を可能にする可能性を秘めています。