こんにちは、スクーティー代表のかけやと申します。

弊社は生成AIを強みとするベトナムオフショア開発・ラボ型開発や、生成AIコンサルティングなどのサービスを提供しており、最近はありがたいことに生成AIと連携したシステム開発のご依頼を数多く頂いています。

近年、AI技術、特に大規模言語モデル(LLM)の進歩が著しい一方で、事実と異なる情報、いわゆる「ハルシネーション」の問題が顕在化しています。これに対処するため、Googleの研究者はRetrieval-Interleaved Generation(RIG)という革新的な手法を開発しました。RIGは、LLMの生成過程にリアルタイムデータの取得を組み込み、正確性と信頼性を向上させることを目指します。

この記事では、Retrieval-Interleaved Generationの仕組みや利点、実装方法などを専門的に解説し、RIGがどのようにAIのハルシネーション問題を解決するのかを詳しく説明するとともに、実際のユースケースや今後の展望についても触れていきます。本文は、全体で詳細な説明と具体例を盛り込み、関連する情報を包括的に網羅することで、読者が本手法の全貌を理解できるように構成されています。なお、文中に図や表も適宜挿入し、視覚的にも内容の理解を補助しています。

Retrieval-Interleaved Generation(RIG)の概要

まずRAGについて知りたいという方は、ぜひこちらの記事を先にご覧ください。

関連記事:生成AIのRAGとは何ですか?専門家が詳しく解説

Retrieval-Interleaved Generation(RIG)とは

Retrieval-Interleaved Generation(RIG)は、大規模言語モデル(LLM)が回答を生成する際に、リアルタイムデータの取得と回答生成を動的に組み合わせる自然言語処理(NLP)の高度な技術です。従来のRetrieval-Augmented Generation(RAG)が回答生成前に外部データを一括して取得するのに対し、RIGは取得プロセスを生成プロセスそのものに統合します。これにより、LLMは回答の一部を生成しながら、外部データソースにアクセスして継続的に必要な情報を取り出し、更新されたデータを応答に反映させることが可能です。

さらに、RIGはユーザーの要求に即応してデータを取得するため、最新情報をリアルタイムで活用できる点が大きな特徴となります。たとえば、地理的な分布や統計情報のようなデータを必要とする質問において、部分回答の生成と同時に、必要な数値や事実の具体的な情報を逐次取得できる点は、従来の手法にはない柔軟性と正確性をもたらします。さらに、この手法は、LLMが固定された内部知識に依存することなく、変動する実世界のデータをリアルタイムに統合するため、応答の正確性や情報の鮮度が非常に高く維持されることが期待されます。

結果として、RIGは、経済統計、医療情報、金融データなど常に変化する情報環境において、極めて有用なソリューションとして実装されるとともに、今後のAI技術の発展において中心的な役割を果たすと考えられます。こうした点を踏まえ、RIGは最新の外部データを柔軟に取り込むことで、ハルシネーションのリスクを低減し、非常に正確な情報提供を実現する先進的な手法として注目されています。

RIGの仕組み

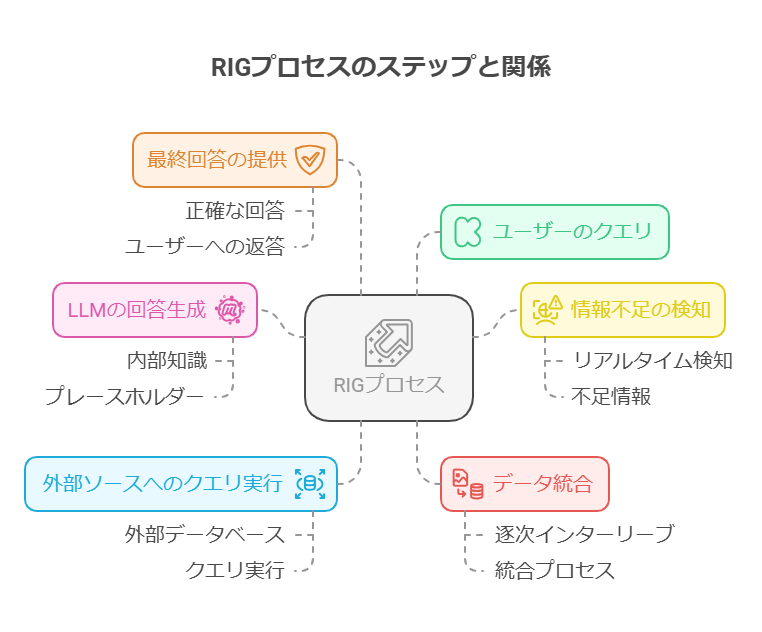

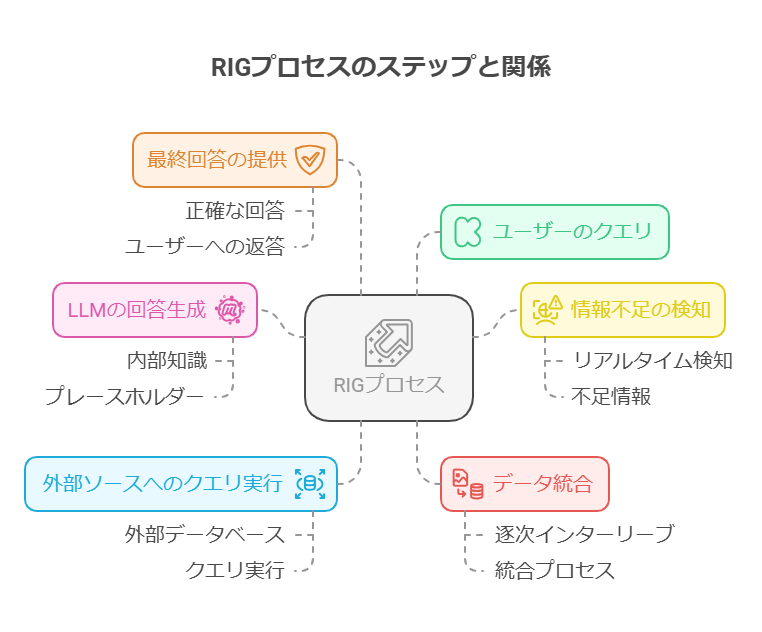

RIGのプロセスは、ユーザーからのクエリ送信から応答生成までの各段階において、データ取得と生成が密接に連携する仕組みとなっています。ユーザーが自然言語によるクエリをLLMに送信すると、モデルは内部知識を元に部分的な回答生成を開始します。この際、数値や具体的な情報が不足している場合は、あらかじめプレースホルダーや推測的な回答が生成されます。その後、LLMは不足している情報に気づき、リアルタイムで外部データソース(データベース、ナレッジグラフ、Web APIなど)に問い合わせを行い、最新かつ正確なデータを取得します。そして、取得された情報はその都度回答生成プロセスに取り込まれ、部分的に生成された回答が上書き・補完される形で最終的な回答が構築されます。以下は、RIGのプロセスの主なステップです:

- ユーザーが自然言語でクエリを送信

- LLMが内部知識を基に部分的な回答を生成(プレースホルダーを含む)

- 不足している情報を検知し、リアルタイムで外部ソースにクエリを実行

- 取得したデータを回答生成過程に逐次インターリーブしながら統合

- 最終的な、正確な回答をユーザーに返す

RIGの利点

Retrieval-Interleaved Generation(RIG)の大きな利点は、まずLLMのハルシネーション、すなわち事実と異なる誤情報の生成を大幅に削減できる点にあります。これは、RIGが回答生成中に常に信頼性の高い外部データソースへ問い合わせを行い、最新の正確な情報を取得する仕組みを採用しているためです。従来のLLMは、事前トレーニング時の内部知識に依存して言語生成を行うため、その知識が古い場合や不十分な場合、誤った情報が出力されるリスクがありました。しかし、RIGではリアルタイムに外部データをフェッチすることで、このリスクを劇的に低減し、応答内容が現実世界の事実に一致するように補正されます。

さらに、RIGは生成プロセス中に動的なデータ更新が可能なため、複雑な質問への多段階的な対応も容易になっています。例えば、金融や経済関連の質問において、初期の部分回答が生成された後に、外部データベースから最新の数値を取得することで、常に正確な統計情報が反映されます。この動的更新能力により、RIGは信頼性の高い情報提供を実現し、研究、政策立案、ビジネス分析などの分野で、その正確性と柔軟性が高く評価されています。

リアルタイム適応の強み

RIGのもう一つの重要な特徴は、回答生成プロセス中にリアルタイムで取得した情報を即時に取り入れるという高い適応力にあります。従来のRetrieval-Augmented Generation(RAG)では、応答生成前に一括して外部データを取得するため、取得後の情報が変化してしまう可能性がありました。一方、RIGは部分回答の生成と並行して、複数回にわたるデータ取得を行うため、常に最新情報が反映された回答をユーザーに提供することができます。

具体的には、ユーザーの問い合わせに対し初期の推測的な回答を生成した直後、必要な統計情報や事実が判明した場合には、その都度リアルタイムで外部ソースから正確なデータを取得し、回答を逐次アップデートします。これにより、たとえば急激に変動する株価や市場指標のようなタイムリーな情報にも柔軟に対応し、ユーザーに常に現実に即したデータを基にした回答を提供することが可能となっています。

GoogleのDataGemmaによるRIGの実装

DataGemmaの紹介

2024年9月、GoogleはLLMのハルシネーション問題に対処するための革新的なソリューションとしてDataGemmaを発表しました。DataGemmaは、GoogleのData Commonsの膨大なデータリソースを活用し、LLMの出力を現実世界の統計データに基づいた正確なものに固定することを目的としています。Data Commonsは、米国国勢調査局や世界銀行などの信頼できる情報源から得られたデータを統合したオープンナレッジリポジトリであり、DataGemmaはこれを利用することで、LLMがリアルタイムで最新かつ正確な統計情報を取り込む仕組みを実現しています。

これにより、AIが生成するコンテンツは、従来の内部知識だけに依存することなく、常に最新の外部データを参照するため、誤情報や古い情報に基づく回答が大幅に削減されるとともに、精度の高い情報提供が可能となります。さらに、DataGemmaは特に複雑なクエリに対しても、信頼性の高い統計データを瞬時に取得・統合できる能力を有しており、研究、政策立案、ビジネス分析などの分野でその応答品質の高さが高く評価されています。

DataGemma-RAG-27B-ITとDataGemma-RIG-27B-ITの紹介

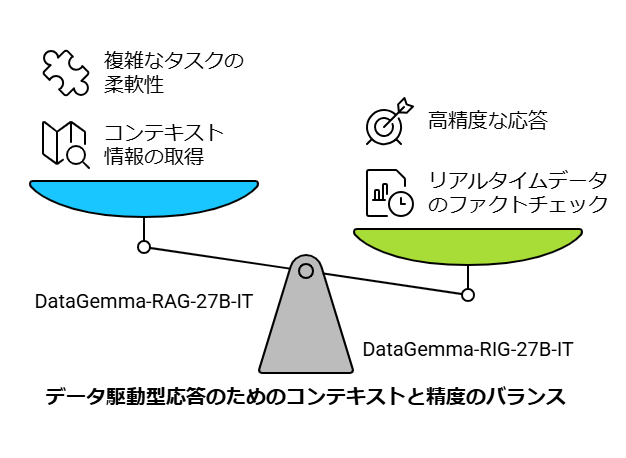

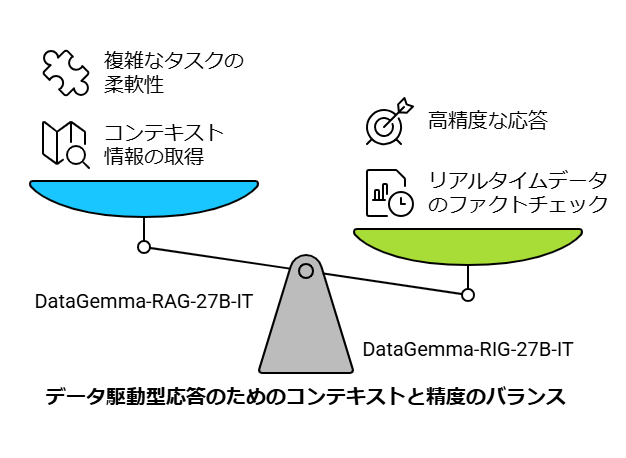

Googleは、LLMの機能強化と高精度な応答実現のため、Data Commonsの大規模なデータ資源を最大限に活用した2種類の高度なモデル、すなわちDataGemma-RAG-27B-ITとDataGemma-RIG-27B-ITを導入しました。DataGemma-RAG-27B-ITモデルは、多様なデータソースから豊富なコンテキスト情報を取得し、複雑なタスクや多次元の統計解析に適した設計がなされており、複数のドキュメント統合が必要なクエリに対して柔軟に応答します。

一方、DataGemma-RIG-27B-ITモデルは、リアルタイムで外部の信頼性の高いデータソースからデータを取得し、部分回答生成中に動的なファクトチェックおよび検証を行うことで、極めて正確な応答の実現に重点を置いています。両モデルは、各々の手法が持つ特性を最大限に活かし、用途に応じた最適な回答生成を実現するために設計されており、研究、政策立案、ビジネス分析などの高度な要求に対して、その精度と柔軟性が高く評価されています。さらに、これらのモデルは、内部知識と外部データの融合によって、従来の静的なデータ依存性を超えた、動的かつ高精度な情報提供を実現する新たなアーキテクチャとして、今後の発展が期待される分野の基盤技術となっています。

Retrieval-Interleaved Generationのユースケース

ユースケースの具体例と適用分野

Retrieval-Interleaved Generation(RIG)は、その柔軟性と高精度な回答生成能力により、さまざまな実世界のシナリオで応用されています。例えば、ヘルスケア分野では、患者の最新の検査結果、臨床試験の進捗状況、そして最新の医学研究の成果などの情報をリアルタイムで取得し、医師が迅速かつ正確な診断や治療方針の決定に活用できるようサポートを行います。

さらに、金融分野においては、急激に変動する株価、金利、経済指標などが常に更新される中、ユーザーが問い合わせた瞬間に最新のデータを反映した正確な統計情報を提供することで、投資判断や市場分析の精度向上に大いに寄与します。また、科学研究やカスタマーサポートの分野でも、リアルタイム性と正確性が求められる状況下で、変動する情報を逐次取得して統合するRIGの特性が、大きな価値を提供しています。

実際の利用シーンとその効果

RIGは、特に変動性の高い情報環境においてその実力を発揮しています。例えば、各国の経済指標、最新の医療統計、そして市場の動向など、常に更新が求められるデータに対して、ユーザーが問い合わせた瞬間にリアルタイムで最新の数値を取得し、正確な回答を構築する能力は、企業の意思決定や政府の政策立案、さらには国際的な比較分析の場で高い評価を受けています。具体的には、ある国のGDPや、最新の金融指標に関するクエリに対し、初期の部分回答が生成された後、即座に外部ソースから正確な統計データが取り込まれるため、最終的な回答が常に最新で信頼性のあるものとなります。

Retrieval-Interleaved Generationの課題と限界

課題と技術的制約についての詳細な考察

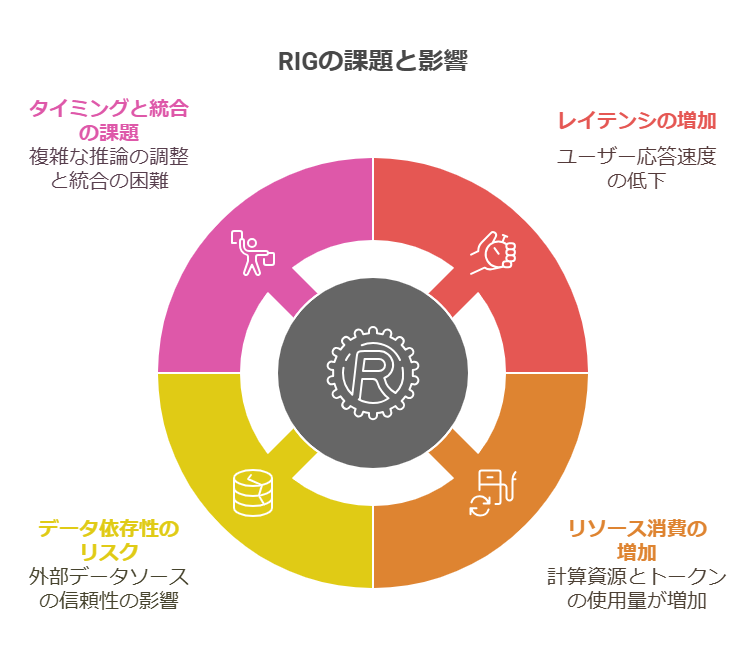

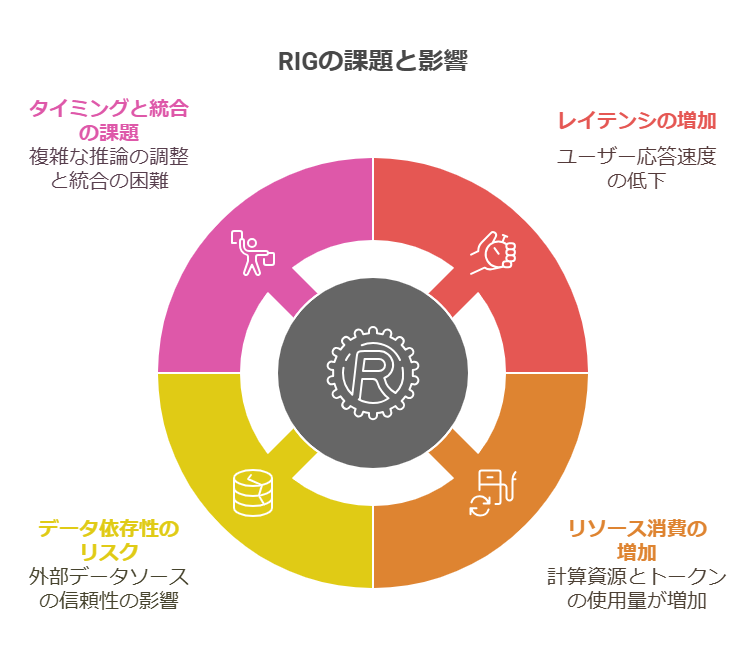

Retrieval-Interleaved Generation(RIG)は優れた技術である一方、いくつかの課題や技術的な制約も存在します。まず、回答生成中に外部データを繰り返し取得するため、システム全体のレイテンシが増加し、ユーザーへの応答速度の低下が懸念されます。また、動的なデータ取得プロセスに伴い、計算資源やトークン数の消費が従来の手法と比べて大きくなることが指摘されています。

さらに、RIGは活用する外部データソース、例えばData Commonsなどのデータプロバイダの信頼性や最新性に大きく依存しているため、これらのデータプロバイダに不具合がある場合、応答の正確性に影響を及ぼす可能性があります。加えて、複雑なマルチホップ推論が求められる場合、動的データ取得プロセスのタイミング調整や情報統合が十分に行えない場合が存在し、これらの課題は今後のシステム改良や最適化によって解決が期待される部分です。

今後の改善可能性と展望

RIGの将来展望については、多くの技術的課題があるものの、継続的なシステム改良や最適化により、解決の余地が十分に存在すると言えます。具体的には、リアルタイムデータ取得の効率化、外部データソースとの連携強化、及び分散処理技術の導入によって、レイテンシ問題やリソース消費の問題が段階的に改善される見込みです。また、最新のアルゴリズム改良や実装上の工夫によって、RIGは自律エージェントとの統合や、様々な分野でのリアルタイム意思決定支援システムとしての応用がさらに進むことが期待されます。

Retrieval-Augmented Generation (RAG)との比較

RIGとRAGの違いとその比較ポイント

Retrieval-Interleaved Generation(RIG)とRetrieval-Augmented Generation(RAG)は、いずれも外部データを統合してLLMの生成能力を向上させる手法ですが、そのデータ統合メカニズムや応答生成上のアプローチに大きな違いがあります。RIGは回答生成中に動的に外部データを取得し、必要な統計情報や事実を直接応答にインターリーブする一方、RAGは生成前に一括して外部データを取得し、その情報を基に入力データの拡張を行う方法です。これにより、RIGはターゲットとなる数値や特定の事実に対して迅速かつ正確に反応する一方、RAGは複数ドキュメントからの情報統合や複雑な推論を要するクエリに柔軟に対応するという特徴を持っています。以下の表は、各手法の特徴を比較したものです。

| 項目 | RIG | RAG |

|---|---|---|

| データ統合メカニズム | 生成中に外部データを逐次取得し、応答に直接インターリーブ | 生成前に一括して外部データを取得し、入力拡張に利用 |

| 効率性 | ターゲットクエリに対して非常に効率的 | 複雑なクエリ対応には柔軟だが処理負荷が高い可能性 |

| 正確性 | リアルタイムデータ取得で事実の正確性を向上 | 取得データが広範囲の場合、細部の精度が低下しうる |

| システムの複雑さ | 単純な実装で高速な処理が可能 | 複雑なクエリ処理のため、より長いコンテキストウィンドウが必要 |

パフォーマンス比較の詳細とその意義

DataGemma論文によると、RIGとRAGのパフォーマンス比較では、各モデルの事実正確性、データカバレッジ、ならびにユーザーの好みの指標において明確な違いが示されています。具体的には、RIGは特定の統計的クエリにおいて大幅な精度向上を実現しており、7Bモデルや27Bモデルにおいてはそれぞれ著しい正確性の改善が確認されています。

一方、RAGは統計テーブルが正しく統合される場合には高い評価を得るものの、複雑な推論が必要とされる場合、ユーザーの評価や誤りの発生率においてRIGとの違いが顕著に現れるという結果が得られています。本セクションでは、これらのパフォーマンス比較の結果を詳細に解説し、各手法の技術的なメリットや制約、及び実際の応用シーンにおける効果について論じることで、今後の技術選定やシステム改良の参考となる情報を提供しています。さらに、比較表や統計データを元に、RIGとRAGの両手法が互いに補完し合うハイブリッドアプローチの可能性についても触れ、今後の展望を示唆しています。

まとめ

本記事では、Retrieval-Interleaved Generation(RIG)の概要、仕組み、利点、実装例としてのGoogleのDataGemma、各種ユースケース、課題・限界、そしてRetrieval-Augmented Generation(RAG)との比較について詳しく解説しました。以下は、この記事の主要なポイントです:

- RIGは、LLMがリアルタイムで外部データを取得することで、ハルシネーションのリスクを低減し、正確性を向上させる革新的な技術です。

- 回答生成と外部データ取得を動的に組み合わせるプロセスにより、最新情報を反映した応答が可能となっています。

- GoogleのDataGemmaは、Data Commonsの豊富な情報資源を活用し、RIGの仕組みを実際に実装することで、特に金融、医療、経済統計等の分野でその効果を発揮しています。

- RIGは、シンプルで効率的な実装が可能な一方、外部データソースへの依存やレイテンシの増加などの課題も抱えており、今後の最適化が期待されます。

- RIGとRAGはそれぞれ異なる強みを持ち、両手法のハイブリッドな活用が将来的なAIシステムの発展に寄与する可能性があります。

本記事を通じて、RIGの技術的背景と実用性、そして今後の可能性について理解を深めていただけたなら幸いです。

この記事では、Retrieval-Interleaved Generation(RIG)の仕組みや利点、実装方法、そしてAIのハルシネーション問題解決について解説しています。弊社では、より柔軟で多様な業界ニーズに対応した生成AIコンサルティングサービスを提供しています。生成AIを活用した業務効率化や新たな価値創出にお悩みの方はぜひご連絡ください。