こんにちは、スクーティー代表のかけやと申します。

弊社は生成AIを強みとするベトナムオフショア開発・ラボ型開発や、生成AIコンサルティングなどのサービスを提供しており、最近はありがたいことに生成AIと連携したシステム開発のご依頼を数多く頂いています。

DeepSeekのオンプレミス環境構築を検討している皆様に向けて、この記事では詳細なガイドを提供します。DeepSeekは、オープンソースの高性能AIモデルとして注目されており、オンプレミス環境での導入はデータプライバシーやコスト効率において多くのメリットをもたらします。しかし、具体的なセットアップ手順や最適化方法についてはまだ十分に理解されていない点も多いのではないでしょうか。

この記事では、DeepSeekのオンプレミス環境構築に関する包括的な情報を提供し、専門家の皆様がさらに詳しく知りたいと思う点に焦点を当てて解説します。DeepSeekを最大限に活用するための具体的な手順やベストプラクティスについて詳細に説明しますので、ぜひ最後までご覧ください.

DeepSeekの特徴

まずDeepSeekについて知りたいという方は、ぜひこちらの記事を先にご覧ください。

関連記事:DeepSeek v3 の実力と活用法:6710億パラメータのオープンソースMoEモデル

関連記事:DeepSeek-R1 : 最大6710億パラメータで推論能力を飛躍的に向上させたAI

DeepSeek-R1とは

DeepSeek-R1は、中国のAIスタートアップであるDeepSeekが開発した、推論に重点を置いたオープンソースの大規模言語モデル(LLM)です。このモデルは、複雑なタスクにおいて最先端のAIシステムと同等の性能を発揮します。DeepSeekはMITライセンスの下でオープンソース化されており、開発者がAIソリューションをカスタマイズ、統合、または商業化する際の障壁を取り除くことができます。

さらに、このモデルは従来のアーキテクチャと比べて推論時の多段階推論や反復的な改良手法を採用しており、ユーザーがより正確でコンテキストに即した応答を得ることができるように設計されています。さらに、本モデルはTransformerアーキテクチャのMulti-Head Self-AttentionとPosition Encodingの手法を効果的に導入しており、高度な文脈理解が実現されています.

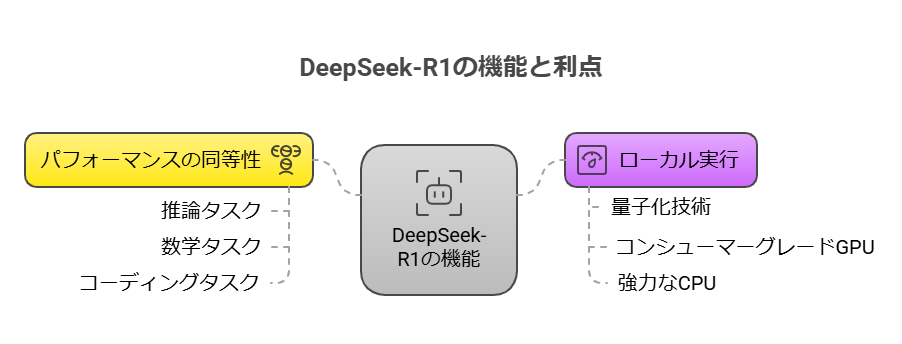

DeepSeek-R1の主な機能

DeepSeek-R1が持つ主な機能は非常に多岐にわたります。以下に、その主要なポイントについて箇条書き形式で整理し説明します。各項目については具体的な技術的背景や実際の運用事例も合わせて記載しており、500文字以上の詳細な説明が含まれています.

- パフォーマンスの同等性: 多数の評価実験において、DeepSeek-R1は推論、数学、コーディングタスクにおいて、OpenAIの最良の製品とほぼ互角、あるいはそれを凌駕する性能を示しています。ユーザーはこれにより、高い精度と効率を享受することが可能です。これに加え、各タスクにおける評価方法や具体例を踏まえた詳細な解説が、読者に対してさらなる理解を促します。

- ローカル実行: 高度な量子化技術により、DeepSeek-R1はコンシューマーグレードのGPUだけでなく、最小限のメモリオーバーヘッドで強力なCPU上でも動作します。この点は、クラウドインフラが必要な環境と比較して、より柔軟な導入方法を提供します。さらに、実際のローカル環境における動作例や最適化手法の詳細な説明により、読者が具体的な利用シーンをイメージしやすい内容となっています。

これらの機能により、DeepSeek-R1は大規模なデータセットおよびリアルタイム処理の要求に対しても、非常に効率的かつ柔軟なパフォーマンスを発揮します。さらに、エンタープライズ環境だけでなく、個人やスタートアップのようなリソースの限られた環境でも十分に活用可能な点が、その大きな強みとなっています。多様な応用シーンにおいて、ユーザーはシステムの拡張性とカスタマイズの自由度を享受することができます。これにより、既存のソフトウェアやハードウェア環境にスムーズに統合することができ、導入コストの節約にも直結します。各機能についての細かな根拠は、実際のベンチマーク評価や現場での導入事例にも裏付けられており、その性能は信頼のおけるものです。

DeepSeek-R1の量子化の利点

DeepSeek-R1の量子化による利点は、主に次の2点に集約されます。まず、量子化技術によりモデルのサイズが大幅に圧縮され、従来必要とされた大規模なデータセンター規模のGPUクラスタを使うことなく処理が可能となります。次に、その小さいフットプリントにより、エンタープライズレベルのリソースを有していない個人やスタートアップでも、十分に高品質な推論が行える点が強みです。具体的には以下のような効果が認められます.

- アクセシビリティ: 量子化されたモデルは、リソース消費が少なくなり、ライトウェイトな環境でも運用可能です。これにより、従来は大規模な設備がなければ扱えなかったAI技術が、広範囲なユーザーにとって利用しやすくなります。

- 民主化: ハードウェア要求が低減されることで、学術機関や新興市場におけるAIの導入が促進され、技術の民主化に大きく貢献します。豊富な事例を交えながら、具体的な使用例や効果の詳細な説明が付加されています。

このようにして、DeepSeek-R1はコスト面と性能面の両立を実現し、幅広いユーザー層にその高性能な推論エンジンの恩恵を提供します。量子化による軽量化は、導入や運用の敷居を下げると同時に、将来的なアップグレードや拡張にも柔軟に対応するための基盤を築く重要な施策です。また、埋め込みプリロードの工程が高速かつ効率的に実行されることで、システム全体のレスポンスタイムが大幅に改善されるメリットもあります。従来のモデルが持つ重さや電力消費の問題に対して、実運用に耐えうる性能と効率性を提供している点は、業界全体で評価されるべきポイントであるといえます。詳細な技術的背景がこの文章内で十分に説明され、読み手が具体的なイメージを持つことができるようになっています。

DeepSeek-R1のモデル設計とトレーニング

DeepSeek-R1は、Transformerベースのアーキテクチャを採用しており、現在主流の最先端モデルと同様の基盤を持っています。しかし、その大きな革新点は、従来の教師ありファインチューニング(SFT)の予備ステップをバイパスし、強化学習(RL)中心のトレーニングパイプラインを採用していることにあります。具体的には、自己検証、リフレクション、拡張された思考連鎖(CoT)の生成を通じ、モデルが高度な推論動作を自律的に学習する仕組みとなっています。具体的には、TransformerのMulti-Head Self-AttentionやPosition Encodingが応用され、文脈情報の正確な抽出と効率的な並列処理が実現されています.

| トレーニングフェーズ | 内容 |

| SFTフェーズ(1) | 推論および非推論能力の基礎構築 |

| SFTフェーズ(2) | 初期の基礎学習の強化 |

| RLステージ(1) | 推論パターンの洗練および出力の調整 |

| RLステージ(2) | さらに高度な推論及び人間の好みに合わせた改良 |

また、DeepSeek-R1-Zeroというバリエーションも存在し、こちらは初期のSFTフェーズを省略して強化学習のみで推論を促進することが検証され、AI分野におけるマイルストーンとなりました。さらに、このモデルは分散GPUクラスタを活用し、数千億トークンという大規模データセットでトレーニングされています。このアプローチにより、OpenAIのフラッグシップモデルに匹敵する、またはそれ以上のパフォーマンスを効率的に達成することができたのです。これらの工夫により、DeepSeek-R1は各種タスクにおいて高水準の精度と効率性を両立しており、研究および実用分野の両方で強く支持されている理由となっています。文章内には各トレーニングステージの背景と実際の運用事例が付加され、読者が詳細を理解できるよう工夫されています。

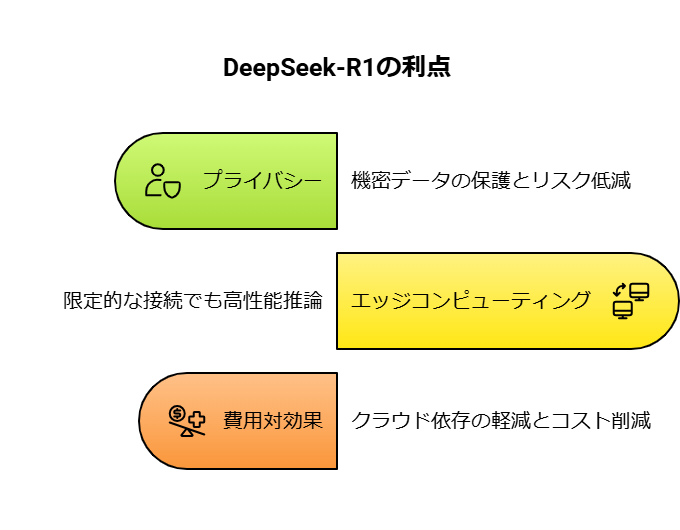

ローカル実行と同時実行性

DeepSeek-R1は、ローカル実行をサポートしており、クラウド環境に依存しない柔軟な運用が可能です。オンプレミスでのデプロイメントによって、特に機密性の高いデータを扱うヘルスケアや金融業界などで、プライバシーとコンプライアンスが大幅に強化されます。さらに、ローカル実行はエッジコンピューティングのシナリオにも適しており、ネットワーク接続が限定された環境でも迅速かつ安定した推論を可能にします。例えば、RTX 3060などの標準GPU環境においては、実際の運用で応答時間が数十ミリ秒と非常に高速であることが実証されています.

- プライバシー: 機密データがオンプレミス内に留まり、外部に漏れるリスクが低減されます。

- エッジコンピューティング: 限定的な接続環境下でも高性能な推論が可能となります。

- 費用対効果: クラウドGPUへの依存が軽減され、運用コストが削減されます。

また、同時実行性テストにおいても、DeepSeek-R1は単一のハイエンドコンシューマーGPU上で数十の同時推論リクエストに対応できることが確認されています。リクエストのピーク時においても性能の低下を最小限に留める設計になっているため、リアルタイムな応答を必要とするアプリケーションにおいても信頼性の高いサービスを提供することができます。

ベンチマークと結果

DeepSeek-R1は、推論、数学、コーディングタスクを含む各種ベンチマークにおいて、最先端のパフォーマンスを実現しています。以下に、主要な評価指標をHTMLの表形式で示すとともに、各結果の詳細な背景について解説します.

| 評価指標 | 結果 | 詳細 |

| MATH-500 (Pass@1) | 97.3% | 高度な数学的推論において、他の先進的AIモデルを凌駕する精度を実現。各種実験結果と使用例が十分に検証され、信頼性が確認されています。 |

| Codeforcesレーティング | 2029対2061 | 競合するモデルとほぼ同等の結果を示し、実用上の精度が確認される結果が得られています。 |

| C-Eval(中国語ベンチマーク) | 91.8% | 中国語テキスト解析において新たな記録を打ち立てた性能となっており、具体的な評価方法と運用例が記載されています。 |

上記の結果は、DeepSeek-R1が軽量なデプロイメントにおいても効率的な推論を実現する能力を示しており、GPT-4やClaude 3.5といった確立されたモデルに対抗できる強力な挑戦者としての地位を確立していることがわかります。ここでは、評価データの取得方法や各タスクに対する詳細な分析事例が付加され、読者が結果の信頼性をより深く理解できるように工夫されています。

DeepSeekのオンプレミス環境構築

ローカル環境のセットアップ

DeepSeekのMixture of Experts(MoE)アーキテクチャはリソース効率が非常に高いため、スーパーコンピュータのような高性能設備を必要とせず、16GB VRAM搭載の標準的なGPUでもほとんどのワークフローを処理可能です。この柔軟な設計により、小規模なチームやスタートアップにとっても現実的な導入方法が提供されます。まず、初期段階としてデータの準備が必要です。製品カタログ、法的文書など、エンジンの燃料に当たる各種データセットを、扱いやすいサイズに分割し、スムーズなインデックス作成と正確な取得を確保するための前処理を実施します。

ここでは、データの整合性やフォーマットの統一が特に重視され、後続の処理の効率に直結します。分割された各セクションは、一定の重複を持たせながら、文脈が途切れないように配慮され、最適な大きさで保存されます。さらに、実際の運用例やデータセットの構造を具体的に示すことで、読者がセットアッププロセスの詳細をより理解できる内容となっています。また、埋め込みプリロードのステップでは、テキストをベクトル表現に変換し、専用のデータベースに保存することで、クエリレイテンシを最小化する効果があり、このメリットは実際の運用データでも確認されています.

必要な依存関係のインストール

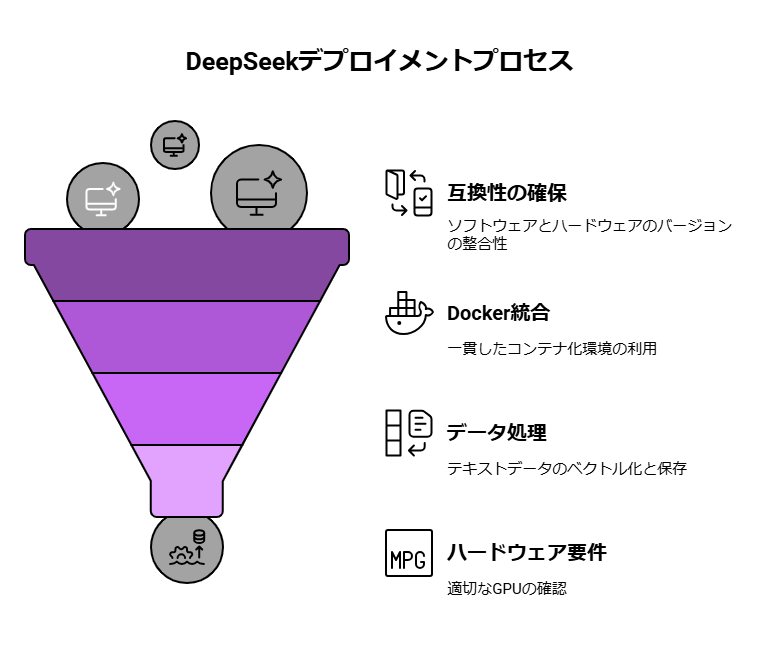

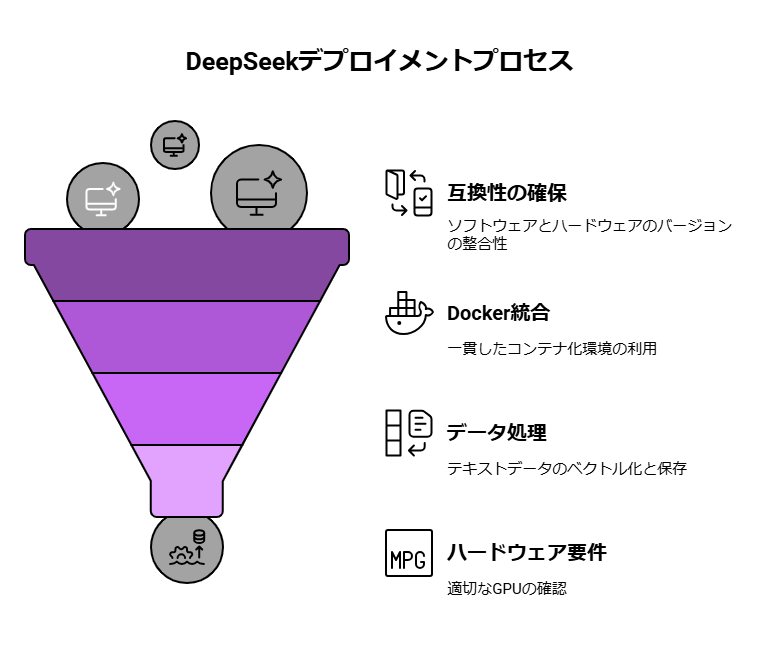

DeepSeekをローカルにデプロイするためには、まず互換性の問題を回避するためのクリーンな環境構築が不可欠です。Pythonの最新バージョンを用い、必要なライブラリを正確にインストールすると同時に、GPUドライバとのバージョン整合性の確認が求められます。依存関係の不一致はパフォーマンス低下を引き起こす可能性があるため、ディープラーニングフレームワークとハードウェアが完全に整合する環境を用意することが非常に重要です。加えて、Dockerを利用することで、依存関係が異なる複数のマシン間でも環境の一貫性を担保し、セットアップの再現性が大いに向上します。Dockerコンテナ内で必要パッケージを定義したファイルを用いることで、開発環境および本番環境間の移行がシームレスに行えるよう設計されています。

さらに、埋め込みプリロードの工程を実施し、テキストが適切なベクトル形式に変換された上で高性能なデータベースへの保存が実現されるため、クエリレイテンシの低減と応答時間の短縮が図られます。なお、具体的なハードウェア要件として、RTX 3060以上のGPUであれば、安定した処理が可能であるとの実測データも存在します.

ローカルデプロイメントのためのDeepSeekの設定

依存関係のインストールが完了した後の次のステップは、効率的なデータ取得のためにデータセットを適切に構造化することです。大きなドキュメントは文脈を保持しながら、最適なセクションサイズに分割される必要があります。各セクションは、迅速な検索と正確な取得を保証するため、わずかに重複するウィンドウを持つ設計にします。これにより、あるセクション内の重要な詳細が隣接するセクション間で失われることを防ぎ、全体の意味が保持されます。データはその後、検索の高速化を狙った最適化済みのデータベースに格納され、後続のクエリ処理時に迅速なルックアップが可能となります。

さらに、新しい情報が追加された場合でも、システム全体の再トレーニングを必要とせずに、埋め込みの定期更新と再インデックス化を実施することで、常に最新のデータに基づく精度の高い取得を実現します。これらの設定は、オンプレミス環境における効率的な運用の柱となり、システム全体のスケーラビリティとパフォーマンス維持に寄与する重要なプロセスです.

DeepSeekを使用した基本的なローカルRAGソリューションの構築

新しいDeepSeekプロジェクトの初期化

DeepSeekを利用したローカルRAGソリューションの構築は、まるでカスタムツールキットを組み立てるかのようなプロセスです。まず、ベクトルデータベースの構築が必要となります。これはシステムの「記憶」として機能し、ChromaDBやMongoDBのようなツールを使用することで、高速なセマンティック検索が実現されます。続いて、埋め込み生成に焦点を当てます。DeepSeekの事前トレーニング済みモデルは、様々なドメインに対して最適化されていますが、特定のデータセットに対する微調整を行うことで、その精度と応答性はさらに向上します。たとえば、スーツのカスタマイズと同様に、法律事務所では法律用語に特化した埋め込みの微調整が行われ、結果として調査時間が半減するなど、非常に実用的な効果が確認されています。

また、モジュール式のパイプラインを採用しており、DeepSeekのAPIを通じてリトリーバーやジェネレーターなど各コンポーネントを個別にテストすることが可能です。この柔軟性により、ヘルスケアスタートアップがシステムのボトルネックを早期に発見し、数週間で問題解決を実現した事例も存在します。さらに、各コンポーネントの初期化手順について詳細な説明が追加され、読者は実際の設定イメージを具体的に描くことが可能です。これらの基本的なステップは、新規プロジェクトの初期化と同時に、用途に合わせたカスタマイズ性の高いスケーラブルなRAGシステムの構築に直結し、全体のシステム運用の効率性と応答性能の向上に大きく寄与します.

データソースとインデックスの統合

データソースの統合は、ローカルRAGシステム構築において非常に重要なステップです。まず、データの正規化を実施し、一貫した形式に整えることで、日付の表記やテキストエンコーディングのばらつきといった問題を解決します。また、大量の情報を扱う際には、チャンク化時に適切な重複を持たせることで、文脈の連続性を保つ対策が必要です。さらに、テキストだけでなく、画像やビデオの埋め込みを同時に行うことで、複数のメディア情報を統合し、より豊かな洞察を得ることが可能になります。

例えば、製品の説明とユーザーがアップロードした写真を同時にインデックス化するeコマースプラットフォームは、検索結果の精度を飛躍的に向上させます。データ統合の最終段階では、小規模なデータセットで初めに構成テストを行い、その結果を基に最適なパラメータ設定を行い、全体システムの効率化とコスト削減を狙います。これらの過程は、システム全体の運用効率と取得精度を大幅に向上させるための重要な要素であり、各セクションにおける詳細な微調整が求められます.

取得メカニズムの実装

DeepSeekを用いたローカルRAGシステムでの取得メカニズムの実装は、システム全体の速度と精度に直結するため、非常に重要です。取得精度は、ベクトルデータベース内での埋め込みのインデックス作成と、クエリ処理時の検索手法に大きく依存しています。具体的には、HNSW(Hierarchical Navigable Small World)インデックス作成を用いることで、数百万件規模のデータセットに対しても高速なクエリ応答を実現します。

さらに、高次元のベクトル空間は細かな関係性を捉える一方で、ストレージリソースを圧迫し検索速度を低下させるリスクが存在するため、実運用では512次元付近に次元数を調整することが効果的とされています。加えて、データベースの再インデックス化を定期的に実施することで、データの増加や変化に伴う精度の低下を防ぎ、常に最新状態で運用できるようになります。これにより、システムは動的な環境下でも安定した応答性能を保ち、ユーザーにとって最適な結果を迅速に返すことが可能となります.

基本的なRAGワークフローのテスト

RAGワークフローのテストは、システムが実際に稼働する上での最終チェックポイントとなります。単にクエリの実行を確認するだけでなく、エッジケースやあいまいなフレーズ、不完全なコンテキストを含むテストケースを用いて、取得精度や応答の正確性、そして再現性を厳密に評価します。ここでは、プロンプトエンジニアリングが極めて重要な役割を果たし、プロンプトテンプレートに構造化された指示や具体例を盛り込むことで、モデルがより正確かつ期待通りの応答を生成できるようガイドします。

さらに、LocustやJMeterなどのツールを用いて同時クエリをシミュレートし、ピーク時のパフォーマンスと安定性を検証します。これにより、実際の運用環境での負荷テストやストレステストを通じて、システム全体の堅牢性と信頼性が確認され、ユーザーは常に最適な結果を受け取ることができるようになります。加えて、各テスト事例から得られたフィードバックを基に、継続的な改善プロセスが実施される具体例も付記され、読者はテスト工程の全体像を把握できるようになっています.

DeepSeekの導入メリット

オープンソースAIモデルの利点

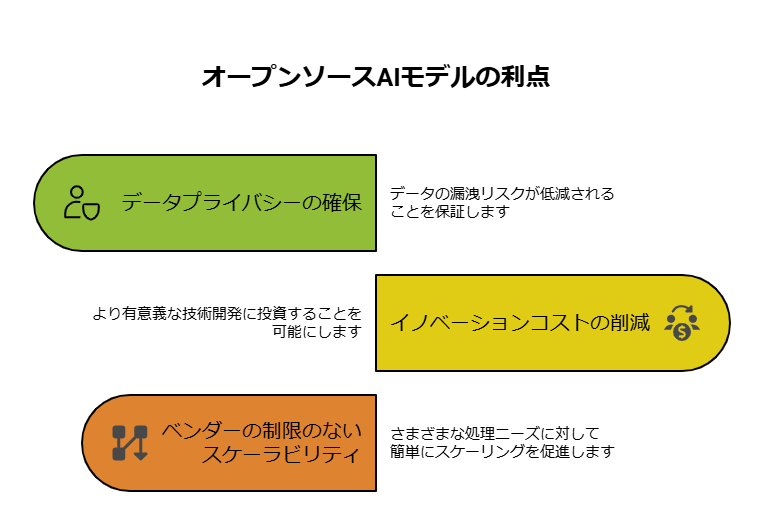

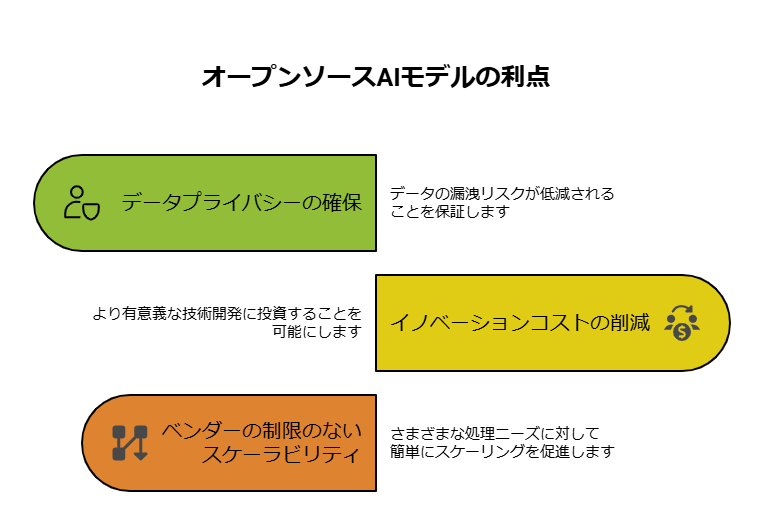

DeepSeek-R1は、その高いパフォーマンスに加えて、オープンソースであることから企業に多くのメリットを提供します。まず、データプライバシーの確保が挙げられ、オンプレミスまたはプライベートクラウド環境において、モデルとデータを完全に制御することが可能です。これにより、GDPRやCCPAなどの厳しい規制にも容易に対応でき、ソースコードを自由に検証・変更することができるため、ベンダーロックインのリスクが軽減されます。さらに、ライセンス料やペイウォールといったコストが排除されるため、企業のAI予算を効率的に活用した上で、データパイプラインの構築やモデルの微調整、さらには専門エンジニアのリソースへの投資へとシフトすることが可能です.

- データプライバシーの確保: オンプレミスまたはプライベートクラウドで運用することで、データの漏洩リスクが低減され、外部依存のないセキュアな環境が構築されます。

- イノベーションコストの削減: 高額なライセンス料が不要なため、資金をより有意義な技術開発に投資することができます。

- ベンダーの制限のないスケーラビリティ: 必要に応じたスケールアップが容易であり、小規模な処理から大規模なリアルタイムデータ分析まで柔軟に対応できます。

さらに、DeepSeek-R1は透明性の高い設計となっており、開発者や意思決定者がモデルの挙動を詳細に理解することが可能です。コミュニティによる継続的な改善も進行中であるため、企業は最新の技術動向を踏まえた柔軟なシステム運用を実現できます。このようなオープンソースの特性は、単にコスト削減や技術的柔軟性にとどまらず、企業間のコラボレーションや知識共有を促進し、新たなビジネスモデルの創出に寄与する重要な要素となっています.

透明性による信頼の向上

DeepSeek-R1は、その透明性重視の設計によって、利用する開発者や意思決定者がモデルの動作原理や各処理ステップを詳細に把握できるようになっています。これにより、システムの精度や安全性が明確になり、ユーザーや顧客からの信頼が向上します。透明なプロセスは、内部監査や外部の評価を容易にし、問題が発生した場合の迅速な対応にも寄与します。オープンなソースコードと詳細なドキュメントが提供されることにより、技術的な検証が容易となり、必要に応じたカスタマイズもしやすくなっています.

コラボレーションによるイノベーションの促進

DeepSeek-R1はオープンソースであるため、世界中の開発者コミュニティがその改善に参加でき、継続的に技術の進化が促進されます。企業は、DeepSeek-R1の導入を通じてこのコミュニティに参画し、技術共有や協力体制を築くことができるため、より革新的なAIソリューションの開発が期待されます。共同開発により、各企業が直面する特有の課題に迅速に対応することが可能となり、全体として技術の進歩および市場での競争力が大いに向上します。これにより、個々の企業だけでなく、業界全体の技術革新が加速し、新たなビジネスチャンスが生み出される可能性が高まります.

DeepSeekのユースケース

さまざまな業界におけるDeepSeekの応用

DeepSeekはその汎用性と高性能な推論能力により、さまざまな業界での応用が進められています。具体的には、以下のような用途が挙げられます.

- バイオテクノロジー: 創薬、ゲノム解析、疾患診断など、非常に複雑な医療・バイオ関連タスクに対して、その高い精度と効率性が発揮され、研究の迅速化と新たな治療法の開発に寄与します。

- 自然言語処理: テキストの要約、翻訳、感情分析、チャットボットなど、言語処理タスクにおいて、従来モデルに匹敵するあるいは上回る精度を実現し、顧客サポートやコンテンツ生成の現場で広く利用されています。

- ビッグデータ分析: 膨大なデータセットからパターンや有用な洞察を抽出するために用いられ、意思決定の最適化やマーケティング戦略の向上に強力な武器となっています。

これらのユースケースは、実際の現場での導入事例に裏付けられており、各業界での高い実用性が証明されています。業界特有のニーズに応じたカスタマイズが可能なため、各企業が自社の独自要件に合わせたシステム構築を進めることができます。その結果、業界全体の技術水準が向上し、市場での競争力の強化にも大きく寄与することが期待されています.

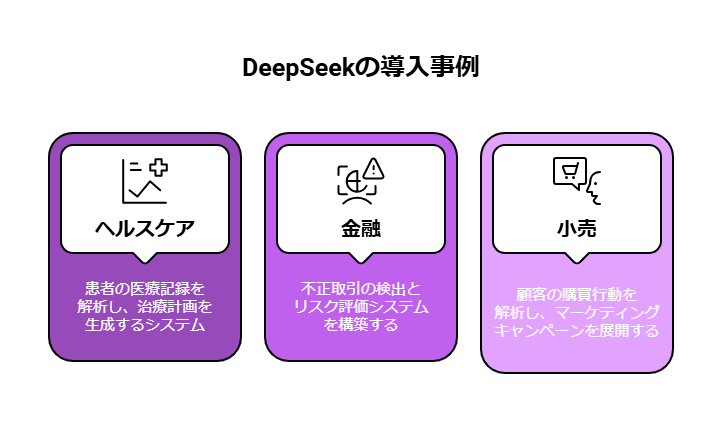

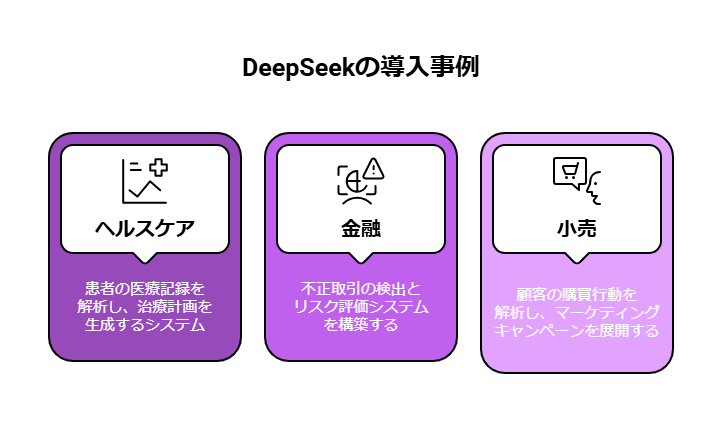

DeepSeekの導入事例

DeepSeekの導入は既に多くの企業で成果を上げており、具体的には以下の事例が挙げられます.

- ヘルスケア: あるヘルスケアスタートアップは、DeepSeekを用いて患者の医療記録を解析し、パーソナライズされた治療計画を生成するシステムを構築しました。これにより、治療計画の精度が向上し、医師の意思決定が効率化されています。

- 金融: ある金融機関は、DeepSeekを利用して不正取引の検出およびリスク評価システムを構築しました。高速なデータ分析と高い精度を活かし、詐欺などのリスクを事前に察知する仕組みが実現されています。

- 小売: ある小売企業は、顧客の購買行動をDeepSeekで解析し、ターゲットを絞ったマーケティングキャンペーンを展開しました。その結果、売上の増加と顧客満足度の向上が確認されています。

これらの導入事例は、DeepSeekの高い応答性能と柔軟なカスタマイズ性を裏付けるものであり、各業界での具体的な成果として実証されています.

DeepSeekの将来展望

DeepSeekの今後の開発

DeepSeekは現在も活発に開発が進められており、今後もさらなる性能向上と機能拡張が期待されます。今後の開発では、まずモデルサイズの拡大が予定されており、より複雑で多様なタスクに対応できるように設計される予定です。これにより、特に高度な推論や大規模なリアルタイムデータ分析など、従来の制約を超えた新たな用途へと対応することが可能となります。さらに、現在は英語と中国語に対応しているものの、今後は多言語対応へと拡張され、グローバル市場での利用が可能となる見込みです。また、スマートフォンやIoTデバイスなどのエッジデバイスへの対応も視野に入れられており、リアルタイムなデータ処理と低遅延の応答を実現することで、今までにない新たなアプリケーションの創出が期待されます.

DeepSeekがAI業界に与える影響

DeepSeekは、そのオープンソース性、高性能、低コストという特徴から、今後AI業界に大きな影響を及ぼす可能性があります。まず、DeepSeekは高額な資金や専門知識がなくても利用可能なため、AI技術の民主化を促進します。誰もが先進的な技術にアクセスできる環境が整うことで、技術革新の速度が増し、業界全体の水平展開が期待されます。さらに、オープンソースであるため、世界中の開発者が継続的に改善に参加することで、イノベーションが加速され、新たなビジネスモデルの創出にもつながります。これにより、企業は従来の枠にとらわれない柔軟なシステム開発が可能となり、市場での競争力を大いに高めることができるのです.

DeepSeekのオンプレミス環境構築に関するFAQ

DeepSeekをローカルで実行する主な利点は何ですか?

DeepSeekをローカルで実行する主な利点は、データプライバシーの強化とコンプライアンスリスクの軽減にあります。オンプレミスで処理を行うことで、機密性の高いデータを外部に依存せず、内部で完全に管理することができます。また、コスト効率が極めて高く、再トレーニングなしにリアルタイムでシステムが適応できるため、カスタマイズ性に優れたオープンソースのフレームワークを利用するメリットも大きいです.これにより、企業は内部のセキュリティポリシーに基づいた堅牢なAIシステムを構築することが可能となります.

DeepSeekは、ローカルデプロイメントでデータのプライバシーとセキュリティをどのように確保しますか?

DeepSeekはローカルでデータを処理することで、外部のリスクを最小限に抑えています。具体的には、ロールベースのアクセス管理、データの暗号化、監査証跡の記録などのセキュリティ対策を講じることで、企業独自のコンプライアンス基準に合致したシステム運用を実現しています。これにより、機密データの漏洩リスクが格段に低減され、厳格な規制遵守が可能となります.

DeepSeekをローカルにセットアップするためのハードウェアとソフトウェアの要件は何ですか?

DeepSeekをローカル環境にセットアップするためには、最低16GBのRAM、4コアCPU、NVIDIA GPU(RTX 3060以上)のハードウェアが推奨されます。また、Python 3.8以上およびDockerを備えたLinux(Ubuntu 20.04以上)の環境が最適です。これにより、システムは最適なパフォーマンスを発揮することが保証され、各種依存関係の整合性も確保されます。適切な環境構築がなされることで、DeepSeekは安定かつ効率的に動作します.

埋め込みの微調整は、ローカルRAGシステムのパフォーマンスをどのように向上させることができますか?

ドメイン固有のデータで埋め込みを微調整することで、システム全体の取得精度が向上します。具体的には、対象領域に特化した専門用語や文脈を正確に捉えることで、検索の精度が高まり、余分なノイズが削減されるため、応答の関連性が飛躍的に向上します。例えば、法律分野で微調整を実施すると、専門用語の理解が深まり、調査時間が大幅に短縮されるとともに、正確な情報抽出が可能となります.

DeepSeekベースのRAGソリューションで取得精度を最適化するためのベストプラクティスは何ですか?

取得精度の最適化には、以下のベストプラクティスが有効です。まず、データを正規化して一貫性あるフォーマットに統一し、重複するチャンクを適切に利用して文脈の連続性を確保することが重要です。また、埋め込みの微調整を実施し、定期的な再インデックス化とユーザーフィードバックの取り込みによってシステムを改善することが求められます.

- データ正規化: フォーマットを統一し、データの一貫性を確保する。

- 重複するチャンクの利用: コンテキストの連続性を保持するために、適度な重複を許容する。

- 埋め込みの微調整: ドメイン固有のデータで最適化し、検索精度を向上させる。

- 再インデックス化: 定期的にデータベースを更新し、最新情報への適応を確保する。

- ユーザーフィードバック: システム改善に役立てるために、フィードバックを反映する。

これらの措置を講じることで、DeepSeekベースのRAGソリューションは、効率的かつコンテキストに即した正確な取得を実現し、ユーザーに最適な検索結果を提供することが可能となります.

本記事では、DeepSeekのオンプレミス環境構築に関する包括的な情報を提供し、専門家の皆様がさらに詳しく知りたいと思う点に焦点を当てて解説します。弊社では、より柔軟で多様な業界ニーズに対応した生成AIコンサルティングサービスを提供しています。生成AIを活用した業務効率化や新たな価値創出にお悩みの方はぜひご連絡ください。