こんにちは、スクーティー代表のかけやと申します。

弊社は生成AIを強みとするベトナムオフショア開発・ラボ型開発や、生成AIコンサルティングなどのサービスを提供しており、最近はありがたいことに生成AIと連携したシステム開発のご依頼を数多く頂いています。

GPTに代表されるLLM(Large Language Model)は、生成AIの中核を担う技術として注目を集めています。しかし、LLMにはデータの鮮度や正確性の面で課題があり、ビジネスでの活用に踏み切れない企業も少なくありません。

そこで登場したのがRAG(Retrieval Augmented Generation)です。RAGは外部データを参照することでLLMの弱点を補い、より信頼性の高い回答を生成することができます。AWSやMicrosoft、Oracleといった大手クラウドベンダーもRAGのサービス提供を始めており、導入のハードルは下がりつつあります。

この記事では、RAGの概要や具体的な活用方法、LLMとの違いなどを分かりやすく解説していきます。

本題に入る前に、生成AIってなに?という方はこちらの記事を先にご覧ください。

弊社でも、外部のネットワークから遮断された環境内にChatGPTと同様の仕組みを作り、ChatGPTと同等の機能を業務利用できる「セキュアGAI」というサービスを提供しています。セキュアGAIをご利用いただくことで社内のRAGを簡単に作成することができます。

生成AIにおけるRAGの位置づけ

RAGとはなに?

RAG(Retrieval Augmented Generation)は、生成AIの能力を強化する技術であり、生成AIモデルがそのトレーニングデータやモデルパラメータには含まれていない外部情報へアクセスすることを可能にします。

この技術の重要な点は、ユーザーが提出したクエリに基づき、関連性の高い情報を外部ドキュメントから検索し、その情報を元に回答を生成することにあります。具体的には、RAGは二段階のプロセス、すなわち検索フェーズと生成フェーズを経て、質の高い回答を提供します。このプロセスでは、まず関連性のある情報が検索され、次にその情報が生成AIモデルにフィードされ、モデルがそれを参照して回答を形成します。

このRAGの技術は、特に大規模言語モデル(LLM)のようなモデルでその価値を発揮します。LLMは、巨大なデータセットから学習しており、膨大な量の一般知識を持っていますが、その知識はトレーニングの時点でのものに限定されます。RAGを使用すると、モデルは最新の情報やドメイン固有のデータにアクセスし、その結果、より正確で時宜にかなった回答を提供することができるようになります。これは、生成AIの精度と信頼性を大幅に向上させるものであり、生成AIを利用するビジネスや開発者にとって大きなメリットをもたらします。

また、RAGは生成AIが提供する回答の透明性を高める効果もあります。回答の根拠となる外部情報へのリンクや引用を提供することで、ユーザーはAIがどのようにしてその回答に至ったのかを理解し、検証することが可能になります。このように、RAGは生成AIの機能を大きく拡張し、より有用で信頼性の高いツールへと変貌させる重要な技術です。

LLMの課題とRAGの登場背景

LLM(Large Language Models)は、ChatGPTをはじめとするAIベースのチャットボットのコアをなす技術として、ここ数年で飛躍的な注目を集めています。

しかしながら、これらのモデルには一つ大きな課題があります。それは、初期の訓練データに含まれていないタスクや、最新の情報が必要とされる場面で、時として誤った情報を提供してしまうことです。この現象は、AIの「幻覚(ハルシネーション)」とも呼ばれ、ユーザーの誤解を招くリスクがあるのです。特に医療や法律といった、正確性が何よりも求められる分野での使用においては、このような誤情報が重大な問題を引き起こしかねません。

こうした課題に対処するべく登場したのが、RAG(Retrieval Augmented Generation)という革新的な技術です。RAGは、LLMが生成する回答の精度を高めることを目的に設計されており、モデルが訓練されていない最新の情報や、特定の分野に特化した情報にアクセスできるようにします。具体的には、ユーザーからの質問に対して、関連する情報を外部のデータベースやインターネット上からリアルタイムで検索し、その情報を基に回答を生成するのです。このプロセスを経ることで、LLMは最新の情報を取り入れた、より正確で信頼に値する回答を提供できるようになります。

RAGの導入によって、生成AIは日進月歩で変化し続ける情報社会の中にあっても、ユーザーのニーズに応えられる高品質なサービスを提供し続けることができるようになります。これは、生成AI技術の発展における重要な一里塚であり、今後のAI応用の可能性を大きく広げるものと言えます。

RAGを使用するとどのようないいことがあるか

RAG(Retrieval Augmented Generation)の登場により、生成AIは様々な分野で大きな変化を遂げつつあります。RAG技術の特徴は、生成AIモデルが、トレーニングデータには含まれていない最新の情報や、特定分野の情報にアクセスできるようにすることです。この進歩は、特に情報が日々更新されるような分野において、AIの回答の正確性と信頼性を飛躍的に高めることを可能にしました。

①生成AIの回答の精度が上がる

RAGは生成AIが提供する回答の質を格段に向上させます。AIが外部のソースから関連情報を取り込むことで、より詳細で具体的な回答をユーザーに提供できるようになるのです。例えば、医療や法律の分野では、最新のデータを即座に取り入れることができるため、その分野の専門家でさえも満足のいく回答を得られるでしょう。

②AIモデルの訓練にかかる時間とリソースを削減できる

RAGの導入によって、AIモデルの学習プロセスがシンプルになります。従来のLLM(Large Language Models)では、膨大な量のデータを使ってモデルを訓練する必要がありましたが、RAGを活用すれば、特定の質問に対する最適な回答を生成するのに必要な情報だけを、リアルタイムで検索し、組み込むことができます。これにより、訓練に要する時間とリソースが大幅に削減され、より効率的なモデル開発が可能になるのです。

③鮮度の高い情報を参照できる

RAGは生成AIの応用範囲を大きく広げてくれます。例えば、最新のニュース記事から情報を取得し分析するジャーナリズムや、リアルタイムの株価情報を基にした金融分析など、様々な分野でのAIの活用が期待されています。これらの分野では、最新の情報が非常に重要となるため、RAGのような技術が不可欠なのです。

まとめると、RAGの採用は生成AIのパフォーマンスを大幅に向上させ、より正確で信頼できる回答を提供することを可能にします。この技術のおかげで、AIは日々更新される情報にも対応できるようになり、多岐にわたる業界での応用が期待されているのです。

RAGはどのような用途が考えられるか

RAG(Retrieval Augmented Generation)技術は、その多様な応用可能性から、様々な分野で革新的な活用が期待されています。この技術を導入することで、生成AIは単に大量のデータを処理するだけでなく、特定の問題解決やタスクの遂行に必要な最新情報を取得し、それを基にした高品質な回答の生成が可能となるのです。

その具体的な用途の一つとして、カスタマーサポートの分野が挙げられます。RAGを搭載したAIチャットボットは、顧客からの問い合わせに対し、製品マニュアルやFAQ、最新のトラブルシューティングガイドなどから、リアルタイムで最適な情報を取り出すことで、より精度の高いサポートを提供できます。これにより、顧客満足度の向上につながるだけでなく、サポートスタッフの負担軽減にも役立つでしょう。

また、研究分野でのRAGの活用にも大きな期待が寄せられています。特に科学や医療分野では、最新の研究成果や論文に基づく情報が重要視されます。RAGを利用することで、AIは研究者の質問に対し、最新の論文やデータベースから関連情報を抽出し、研究の仮説構築やデータ分析に有用な情報を提供できるようになります。これは、研究の効率化や新たな発見の契機となり得るのです。

さらに、教育分野でのRAGの応用も見逃せません。RAGを搭載した教育用AIは、学生の質問に対して、教科書や学術資料、最新の研究結果から適切な解説や事例を提示することができ、個々の学生に合わせた学習サポートの実現が可能になります。このような双方向型の学習ツールは、学生の理解度を高めると同時に、教育者の負担を和らげる効果も期待できるでしょう。

RAG技術はカスタマーサポートから研究、教育に至るまで、幅広い分野での応用が期待されており、生成AIの可能性を大きく広げる存在と言えます。これらの応用を通じて、日常生活から専門的な領域に至るまで、情報の精度と入手の迅速性が飛躍的に向上することが予想されます。

RAGの技術的な仕組み

RAGの仕組み解説

RAG(Retrieval Augmented Generation)は、生成AIの能力を拡張する重要な技術であり、その特徴は情報検索と生成プロセスを巧みに組み合わせた点にあります。この技術の核となるのは、ユーザーからの問いかけに対し、生成AIが単に内蔵された知識ベースだけでなく、外部のデータソースからも情報を取得し、それらを統合して回答を生成するという仕組みです。

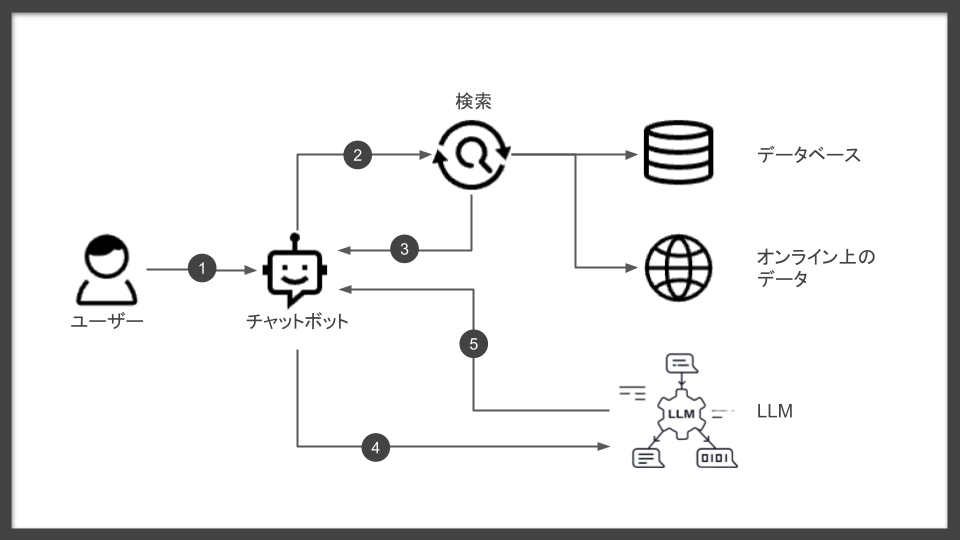

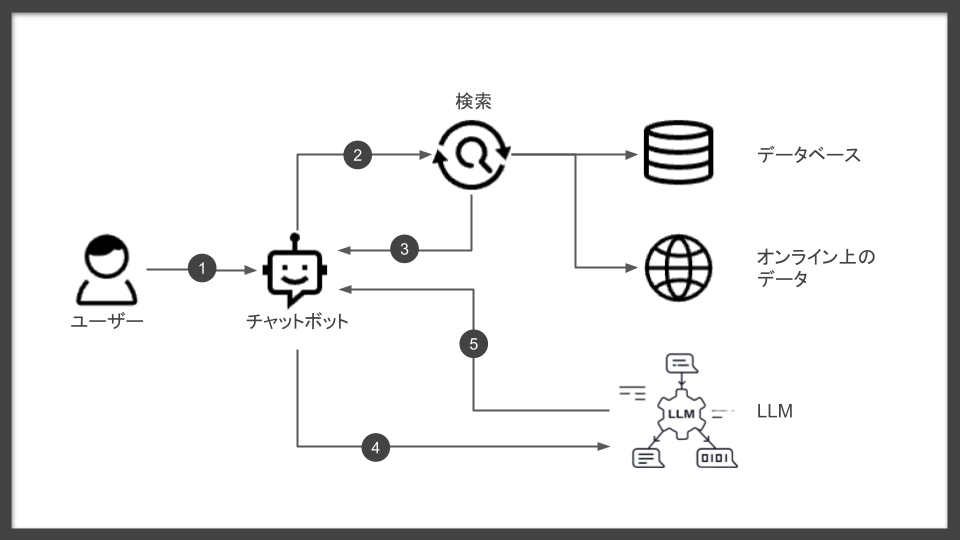

RAGのプロセスを詳しく見ていくと、大きく二つのステップに分けられます。まず第一のステップは「検索(Retrieval)」です(図の②〜③)。ユーザーの問いかけを基に、関連する情報を外部データベースやインターネット上から検索するのです。この際、キーワードや意味的な類似性を手がかりに、最も関連性の高い文書や情報が選択されます。

次に第二のステップとして「生成(Generation)」が行われます(図の④〜⑤)。検索で得られた情報を土台に、生成AIは回答を組み立てていきます。このプロセスでは、検索で得た外部情報とAI自身の内部知識ベースが組み合わされることで、より正確で詳細な回答の生成が可能になるのです。

特筆すべきは、RAGが大規模言語モデル(LLM)と組み合わされることで、その効果を最大限に引き出せる点です。LLMの広範な知識とRAGによるリアルタイム情報の取得能力が融合することで、生成AIは過去のデータやトレーニング時の知識に縛られることなく、最新の情報を踏まえた回答を提供できるようになります。

こうした技術的な仕組みは、特に情報がめまぐるしく更新される分野や、特定の専門知識を必要とする問いかけに対して、非常に有効に機能します。RAGを活用することで、生成AIは従来よりもはるかに適切で、タイムリーな回答をユーザーに提供することが可能になるのです。

以上のような技術的な仕組みを通じて、RAGは生成AIの応用範囲を大幅に拡大し、その性能を飛躍的に向上させる重要な役割を果たしています。この進歩は、生成AIを利用する様々なアプリケーションやサービスの質を高め、より信頼性の高い情報提供を実現するでしょう。

RAGの構成要素と処理の流れ

RAG(Retrieval Augmented Generation)は、前項で述べたように主に二つの重要な構成要素から成り立っています。この二つの要素、すなわち「情報の検索」と「回答の生成」のプロセスが緊密に連携することで、ユーザーのクエリに対して最適な回答を提供することができるのです。

構成要素1: 情報の検索

RAGの第一の構成要素は、外部情報ソースからのデータ検索機能です。ユーザーからのクエリを受け取ると、RAGシステムは関連性の高い情報をインターネットや専門のデータベースから探し出します。この検索プロセスには、自然言語処理(NLP)技術が用いられ、クエリに最も適した情報を見つけ出すのです。ここで特筆すべきは、このステップにより、モデルがこれまでに学習したことのない新しい情報も取得できるという点です。

構成要素2: 回答の生成

検索で得られた情報は次に、生成プロセスに送られます。ここでは、検索した情報を土台として、LLM(Large Language Models)などの生成AIモデルが回答を組み立てていきます。この段階で、AIは検索で得た情報と内部に蓄積された知識を巧みに織り交ぜ、具体的かつ詳細な回答を生み出すのです。こうして生成された回答は、従来のモデルの出力と比べて精度が格段に高く、最新の情報を反映しているのが特徴です。

処理の流れ

RAGの処理の流れを追ってみると、まずユーザーからのクエリを受け取ることから始まります。次に、「情報の検索」フェーズでクエリに関連する情報が外部ソースから検索され、この情報は「回答の生成」フェーズへと受け渡されます。そして最終的に、求められた回答が生成されるのです。この一連の流れを通じて、RAGは従来の生成AIと比べて、より正確で最新の情報に基づいた回答を提供することができるのです。

以上、RAGの構成要素と処理の流れについて説明しましたが、これからもお分かりの通り、RAGは生成AIの能力を大きく拡張し、ユーザーにとってより価値の高い情報を提供するのに非常に有効な技術だと言えます。特に情報が絶えず更新されるような分野において、RAGは生成AIの応用可能性を大きく広げる重要な役割を担っているのです。

RAGの活用事例と導入方法

AzureとAWSにおけるRAG

RAG(Retrieval Augmented Generation)技術の登場は、クラウドサービス業界でも大きな注目を集めています。中でも、AzureとAWSは、この最先端技術を活用することで生成AIの能力を大幅に拡張し、開発者や企業に新たな価値を提供しようとしているのです。

AzureにおけるRAGの活用

Microsoft Azureは、自社のAIと機械学習サービスにおいて、RAGを組み込んだソリューションを積極的に展開しています。AzureのAIサービスは、自然言語処理やコンピュータビジョンといった分野で大きく強化され、RAGの導入によって、これらのモデルがリアルタイムのデータや幅広い情報源から知見を取得し、より精緻な回答や分析を生成できるようになったのです。これにより、Azureを利用する開発者は、自分たちのアプリケーションやシステム内で、ユーザーに対して即時かつ正確な情報提供が可能となり、ユーザーエクスペリエンスの大幅な向上が期待できます。

参考URL

AWSにおけるRAGの利用

Amazon Web Services(AWS)もまた、自社の機械学習サービスにRAGを取り入れることで、生成AIの力を飛躍的に高めています。AWSは、膨大なデータソースへのアクセスを可能にし、エンドユーザーに対して最新かつ関連性の高い情報に基づく回答を提供することを目指しているのです。特に、Amazonの検索サービスやレコメンデーションエンジンにおいては、RAGを活用することでより精確でパーソナライズされた結果を生成することが可能となっています。このことは、eコマースからコンテンツ配信に至るまで、実に多岐にわたるサービスの品質向上に大きく寄与しているのです。

参考URL

AzureとAWSにおけるRAGの活用は、クラウドベースのAIサービスの進化の方向性を示唆しています。両プラットフォームは、RAGを通じて実現されるリアルタイムでの情報アクセスと、生成AIの高度な分析能力を組み合わせることで、開発者にとって非常に強力なツールを提供しているのです。

これにより、アプリケーションやシステムがユーザーのニーズに応じて迅速に進化し、より関連性の高い情報を提供できるようになるでしょう。RAGの導入は、クラウドコンピューティングの未来において、生成AIの応用可能性を大きく広げる鍵となるかもしれません。

社内システムへのRAG導入の課題とポイント

社内システムにRAG(Retrieval Augmented Generation)を導入することは、組織の情報処理能力とサービス品質を飛躍的に向上させる大きな可能性を秘めています。しかし、その一方で、いくつかの課題も伴うのが現実です。RAG導入の成功への道のりを歩むためには、これらの重要なポイントを深く理解することが欠かせません。

課題1: データの質とアクセス性

RAGのパフォーマンスは、利用可能なデータの質に大きく左右されます。社内システムにRAGを導入する際は、最新かつ正確な情報を確実に取得できるデータソースへのアクセスが不可欠です。また、機密性の高い情報を扱う場合、セキュリティとプライバシー保護の問題が大きな課題として浮上します。

ポイント: データの整理とデータクレンジングに十分な時間を割くこと、そしてセキュリティ対策に万全を期すことが肝要です。加えて、外部情報源との連携を図る際は、信頼性の高いデータソースを選び抜き、定期的な更新を怠らないようにしなければなりません。

課題2: 技術的な実装と統合

RAGを社内システムにスムーズに統合するためには、技術的なハードルを一つ一つクリアしていく必要があります。既存のシステムとの互換性の問題や、RAG技術の核となるAIモデルのトレーニングには、専門的な知識と十分なリソースが求められます。

ポイント: 技術的な実装に際しては、専門家の意見に耳を傾け、必要に応じて外部の専門家やコンサルタントの力を借りることが賢明です。また、段階的な導入とテストを繰り返し、システムの安定性を入念に確認することが肝心です。

課題3: ユーザーの受容性

新しい技術の導入は、ユーザー側の受容性に大きく影響されます。RAGを活用したシステムが提供する情報の質や、対話式のインターフェイスに対するユーザーの期待と現実とのギャップが、導入の障壁となる可能性があるのです。

ポイント: ユーザートレーニングを実施し、フィードバックを積極的に収集することで、ユーザーの期待に応えるシステム設計を目指すことが大切です。また、ユーザーが新しいシステムに慣れるまでの間、手厚いサポート体制を整えておくことが重要です。

社内システムへのRAG導入は、情報アクセスと処理の効率化をもたらす一方で、データ管理、技術的な実装、ユーザーの受容性など、様々な課題に直面します。これらの課題に真正面から向き合い、導入の成功を手にするためには、入念な準備と綿密な計画が不可欠です。組織がこれらのポイントを深く理解し、適切な対策を講じることで、RAGの持つ無限の可能性を最大限に引き出すことができるはずです。

RAG技術の向上と展望

RAG(Retrieval Augmented Generation)技術の進化は、生成AIの未来における重要な転換点を示しています。この技術の飛躍的な向上は、情報検索と生成のプロセスを巧みに融合することで、AIが提供する情報の質と精度を大幅に高める可能性を秘めているのです。将来を見据えたとき、RAG技術の展望は以下の三つの主要な方向性に集約されるでしょう。

技術的な精度の向上

RAG技術の核心は、正確な情報検索と、それに基づく質の高いコンテンツ生成にあります。今後、自然言語処理(NLP)技術や機械学習アルゴリズムの目覚ましい進歩により、より関連性の高い情報を瞬時に検索し、その情報を土台により自然で理解しやすい回答を生成する能力が飛躍的に向上することが期待されます。これにより、RAGはユーザーに対してより価値ある体験を提供できるようになるでしょう。

応用分野の拡大

RAG技術の応用範囲は、現在も留まることを知りません。医療、法律、金融といった専門知識を要する分野にとどまらず、教育、エンターテインメント、ニュースといった私たちの日常生活に密接に関わる分野でもその利用が加速しているのです。将来的には、RAG技術を活用した革新的なサービスやアプリケーションが続々と登場し、人々の生活やビジネスのあり方に大きな変革をもたらすことが期待されます。

倫理的な問題への対応

RAG技術の発展に伴い、情報の正確性や偏り、プライバシー保護といった倫理的な問題への対応が喫緊の課題となります。特に、外部情報源からのデータ検索においては、信頼性の高い情報のみを使用し、誤解を招くような内容や偏見を含む情報を排除する仕組みの構築が不可欠です。このためには、技術的な改善だけでなく、法的・倫理的なガイドラインの策定も同時に進める必要があるでしょう。

RAG技術の向上と展望を語る上で、技術的な精度の向上、応用分野の拡大、そして倫理的な問題への対応という三つの重要なポイントが浮かび上がります。これらの要素に真摯に取り組むことで、RAGは生成AIの可能性をさらに広げ、社会に計り知れない影響を与える技術へと成長を遂げるでしょう。これらの展望を追求する過程で、RAG技術は絶え間ない進化を続け、新たな価値を生み出し続けることが期待されるのです。